中文标题:基于可信网络的图像解析

英文标题:Learning to Parse Images

发布平台:NIPS

发布日期:1999-11

引用量(非实时):72

DOI:缺失

作者:Geoffrey E Hinton, Zoubin Ghahramani, Yee Whye Teh

文章类型:journalArticle

品读时间:2022-03-29 16:21

1 文章萃取

1.1 核心观点

使用解析树作为图像的内部表示(简单举例理解:脸是由鼻子、眼睛、嘴组成,眼睛由眼珠、眼皮、眼睫毛组成),建立名为可信网络(credibility networks)的概率模型。可信网络能够在识别图像的同时自动进行分割处理,在手写数字分割问题上取得了很好的效果。

1.2 综合评价

- 考虑到视觉识别的层次结构,并充分利用结构与概率

- 在识别建模的同时实现了效果优秀的启发式的图像分割

- 基于EM的概率算法过于依赖数据量,收敛困难,相对计算成本高

- 论文算法细节描述不够清晰,实验部分较为单调,缺乏多场景验证

1.3 主观评分:⭐⭐⭐⭐

本论文作为Hinton的早期作品,从中可以一窥capsule结构的影子,此时的Hinton已经非常关注于增强模型对于图像的层次理解与局部抽象,只不过这时的可信网络还是生成式概率模型+图结构(解析树),如果把这种思想融入到深度学习的网络结构中时,Capsule也就应运而生了

2 精读笔记

2.1 模型起源

在很多图像识别的研究过程中,都需要进行单独的图像分割预处理过程。这个过程包含两个问题:1. 待识别物体的形状信息缺失导致分割困难;2.图像分割过程舍弃了物体周边的信息。

物体本身就存在局部和整体的描述,而结构与概率的共存效果(结构语言学的启发)也已经证明是有效的。因此本文提出了一种依赖于图像解析树的图像解释模型,借助潜在变量关联像素信息和类别信息,进而实现图像的自动化分割。

2.2 模型结构

本文构建的可信网络尺寸为$256-64-4$,其中模型输入为$16\times 16$的图像像素点展开,第二层为$64$个潜在变量用于描述图像的特征分布,最后一层的$4$个变量对于输出类别的编码(推测是$0-1$编码,这样$2^4>10$)。

不同层之间存在类似于神经网络的边关系,边的取值只能选择0或1,用于描述两个节点间是否存在关联关系。底层的特征分布本质上是浅层特征的条件分布,模型追求的是最大似然估计

个人理解,图像是多个分布的叠加,假设输入数据是人脸图像,则原始分布人脸分布,而人脸分布其实是多个分布的叠加,每一个潜在变量都在尝试寻找一种潜在分布,比如鼻分布、眼分布、嘴分布、毛发分布,而最后一层的变量分布可以理解为与最终识别信息更为密切的分布,比如从嘴分布中提取女性常见嘴分布,从毛发分布中提取男性常见胡子分布。这种深层分布信息将绝对最终的模型预测结果。

针对存在隐变量的最大似然估计模型,训练主要通过EM算法来实现

此小节以理解为主,具体公式与算法细节详见论文原文

2.3 手写数字分割

本文通过$7000$个样本训练模型,然后用$1600$样本进行测试,分类错误率$5.5%$

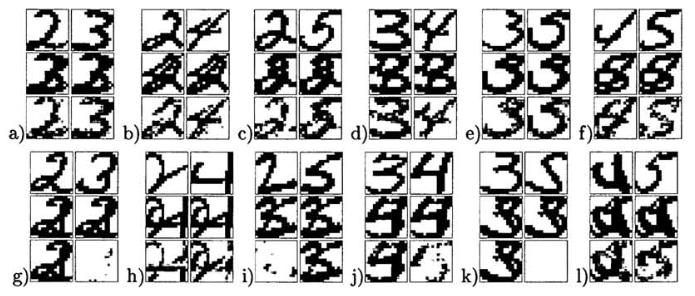

通过两个图像完全叠加的方式生成$120$份待分割样本,人类区分错误率为$19.2%$,而可信网络模型的区分错误率为$21.7%$,待分割样本示例如下:

上图中,图$(a-f)$描述了分割成功的样本,图$(g-l)$描述了分割失败的样本,每个子图的第一行表示原始的两个图像,第二行表示人为叠加后的待分割图像,第三行表示模型分割后的效果。

可以发现,最终模型分割效果优秀,且无需过多认为干预。对于最终模型,每种潜在特征抽取出一种多元高斯分布(包含位置、方向和比例等信息),不同层之间的边取值(0或1)描述了类别与特征间的抽象关系(整体与部分,分割与组成)。