1 传统机器学习

1.1 XGBoost

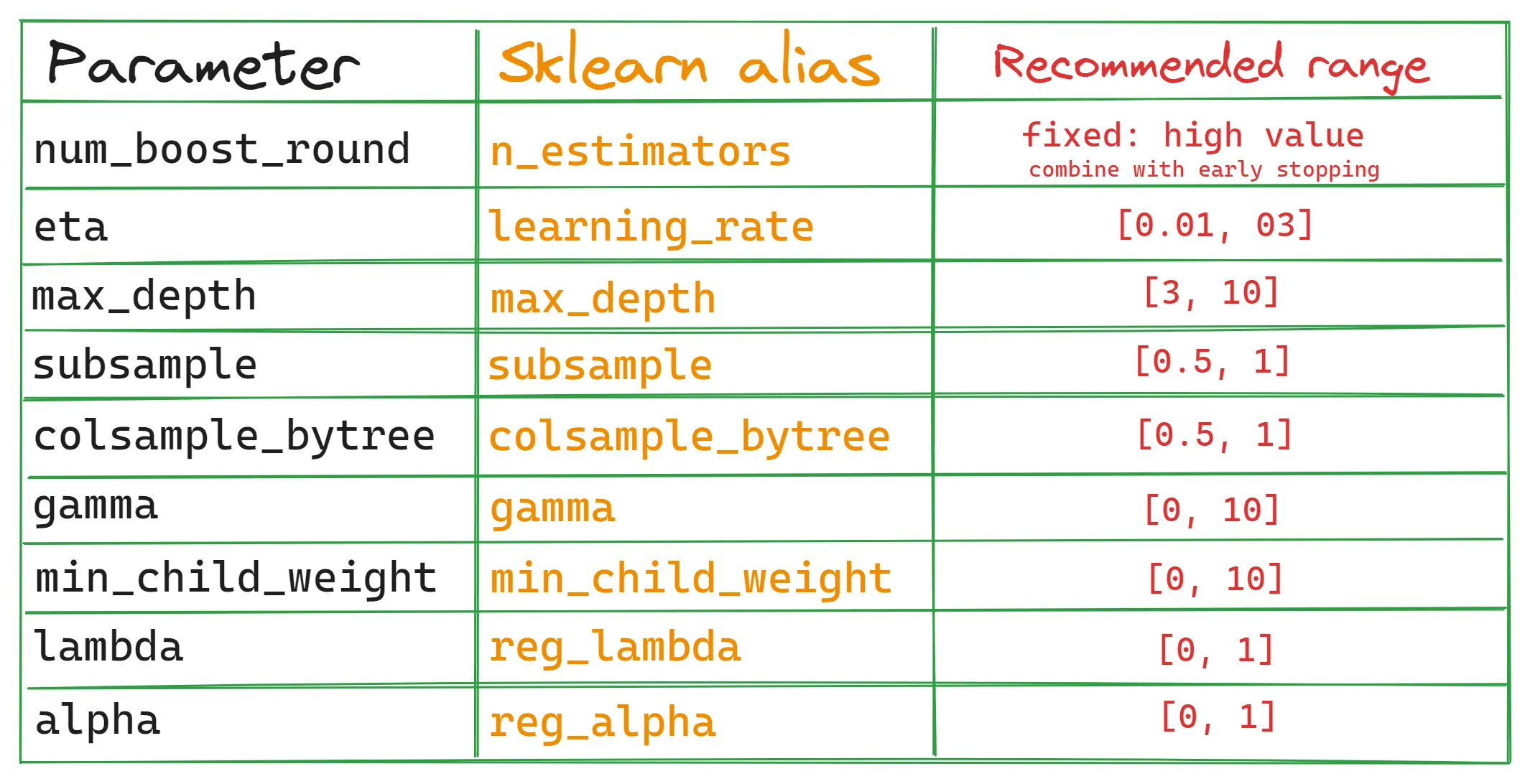

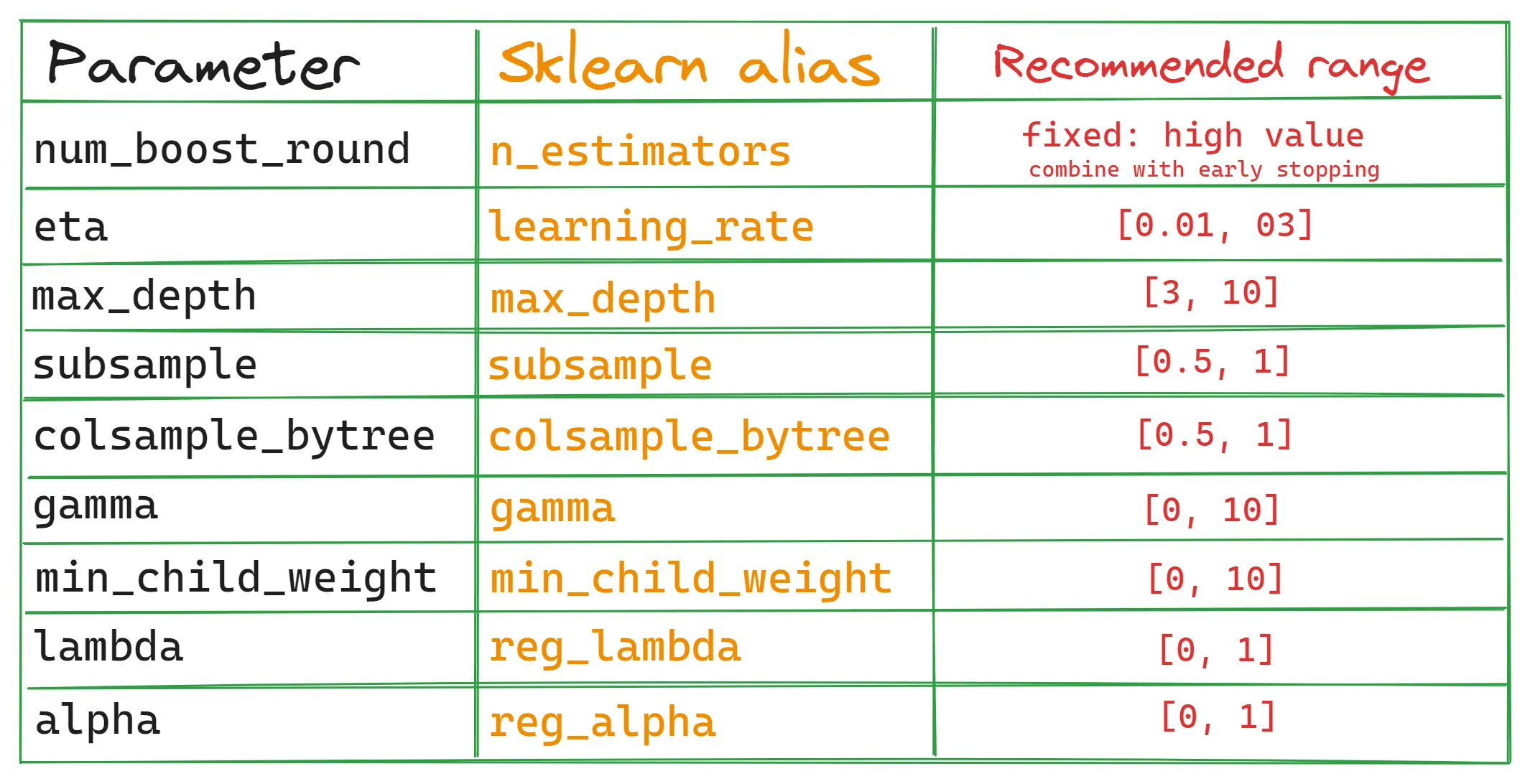

最常用的10个超参数(原生API,兼容Scikit-learn的API,常见取值范围):

num_boost_round:训练期间所需要的基学习器数量,默认100;在应对较大数据集时,一般控制在5000~10000左右(影响训练时间的重要因素);一个常用技巧是先设定一个较高的数值,然后结合early-stop

分类目录归档:模型开发技巧

最常用的10个超参数(原生API,兼容Scikit-learn的API,常见取值范围):

num_boost_round:训练期间所需要的基学习器数量,默认100;在应对较大数据集时,一般控制在5000~10000左右(影响训练时间的重要因素);一个常用技巧是先设定一个较高的数值,然后结合early-stop网格搜索(Grid Search)会遍历给定参数空间内的所有参数组合,并选择最优的一组,相对于暴力枚举法,有点浪费时间

随机选择(Randomized Search)参数空间内的参数组合,可能有的参数组合不会被选到,效率比网格搜索高

贝叶斯优化(Bayesian Optimization)是一种通用的黑盒优化