1 传统机器学习

1.1 XGBoost

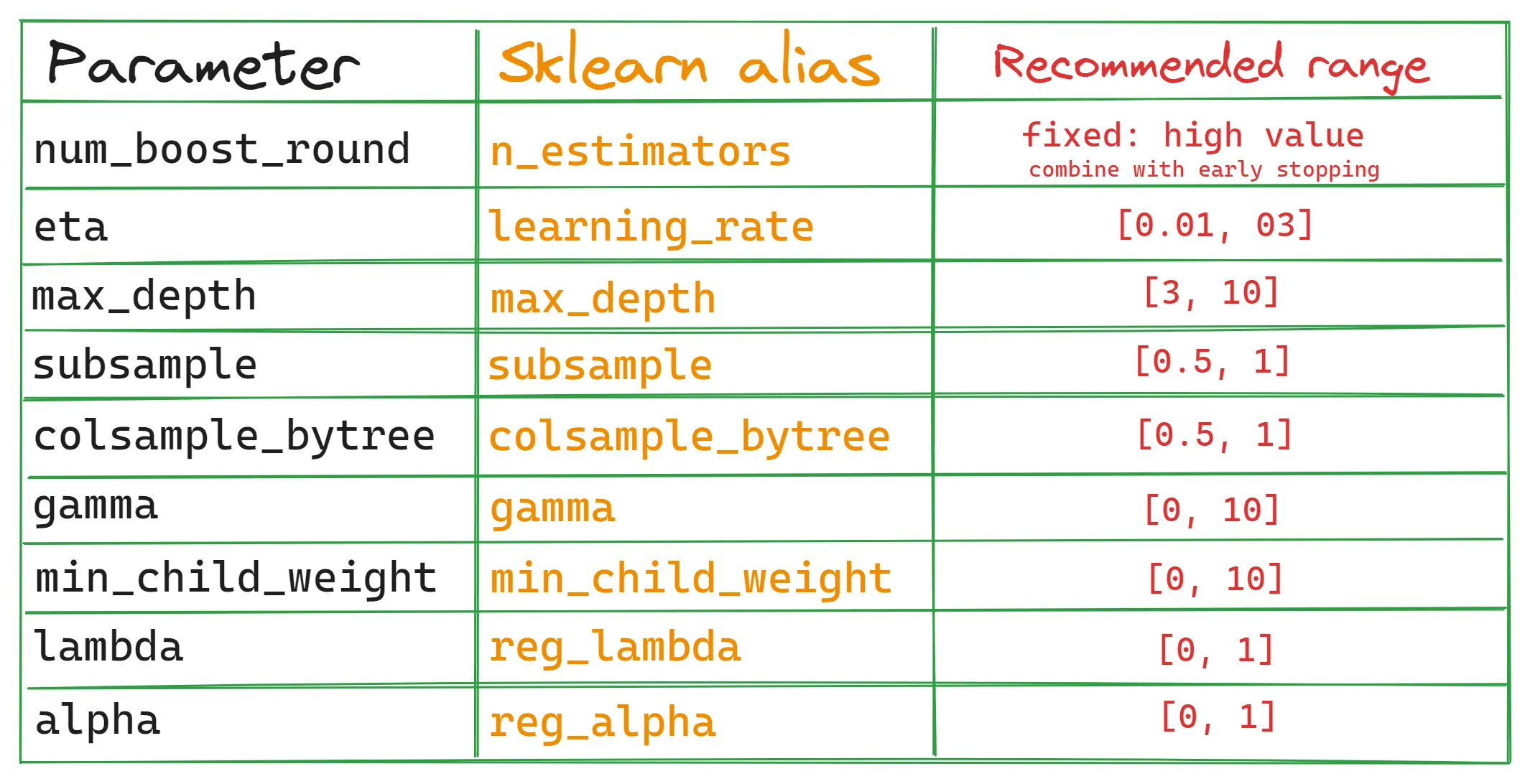

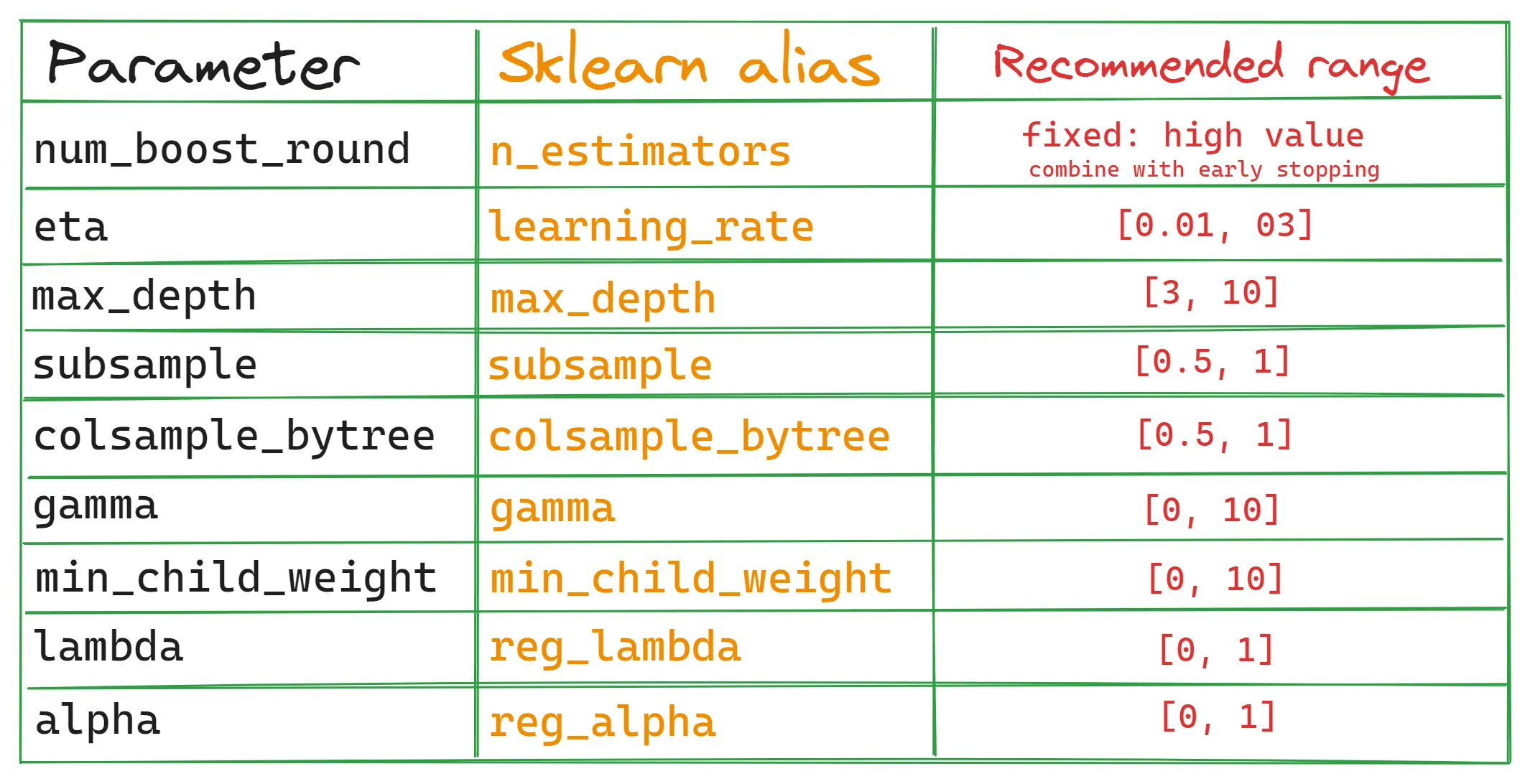

最常用的10个超参数(原生API,兼容Scikit-learn的API,常见取值范围):

num_boost_round:训练期间所需要的基学习器数量,默认100;在应对较大数据集时,一般控制在5000~10000左右(影响训练时间的重要因素);一个常用技巧是先设定一个较高的数值,然后结合early-stop

分类目录归档:MachineLearning

最常用的10个超参数(原生API,兼容Scikit-learn的API,常见取值范围):

num_boost_round:训练期间所需要的基学习器数量,默认100;在应对较大数据集时,一般控制在5000~10000左右(影响训练时间的重要因素);一个常用技巧是先设定一个较高的数值,然后结合early-stop又称为数据不平衡(imbalanced)问题,指分类任务中不同类别之间的样本数差异过大的情况。数据偏斜常见于医疗诊断、文本分类、金融欺诈、异常检测等领域,一般认为样本比例大于4:1时,便存在样本不平衡的问题,一些极端的场景下,会存在1000:1的样本比例,甚至一个类型只有一个样本的情况

数据偏斜问题的影响:干扰建模过程,错

本文罗列了一些热门的自动机器学习项目

AutoGluon 更倾向于使用多模型的 ensemble,利用多层 stacking + k-fold bagging 来实现更好更稳定的模型效果。当然基本的超参优化也是具备的。

自带了一系列的特征工程自动化组件,例如各种缺失值的预处理,日期特征,类别特征,文本特征处理等。但这部分功能相对基础

针对部署时进行优化,比如训练子模型替代多模型;引入模型蒸馏

代码整

网格搜索(Grid Search)会遍历给定参数空间内的所有参数组合,并选择最优的一组,相对于暴力枚举法,有点浪费时间

随机选择(Randomized Search)参数空间内的参数组合,可能有的参数组合不会被选到,效率比网格搜索高

贝叶斯优化(Bayesian Optimization)是一种通用的黑盒优化

如何理解并区分误差(error)/损失(loss)/成本(cost)/目标(objective)函数?

常用特征处理:

更多时序类衍生特征可参考1_study/Python/Python 数据处理/tsfresh 时序特征聚合工具

其他特征处理技巧:

preprocessing.PolynomialFeatures)pandas.cut)