中文标题:语言模型表征空间和时间

英文标题:Language Models Represent Space and Time

发布平台:预印本

发布日期:2023-01-01

引用量(非实时):

DOI:10.48550/ARXIV.2310.02207

作者:Wes Gurnee, Max Tegmark

文章类型:journalArticle

品读时间:2024-02-24 17:43

1 文章萃取

1.1 核心观点

本文通过构建三个空间数据集(世界、美国、纽约地区)和三个时间数据集(历史人物、艺术品、新闻标题),来分析 Llama-2 系列模型的学习表示。本文发现目前的 LLMs 包含了用于编码时空的"神经元",这使得 LLMs 掌握了有关空间和时间等基本维度的结构化知识,这种知识对应了一套稳健多尺度的空间和时间线性表示,即使在提示的干扰下也是稳健的

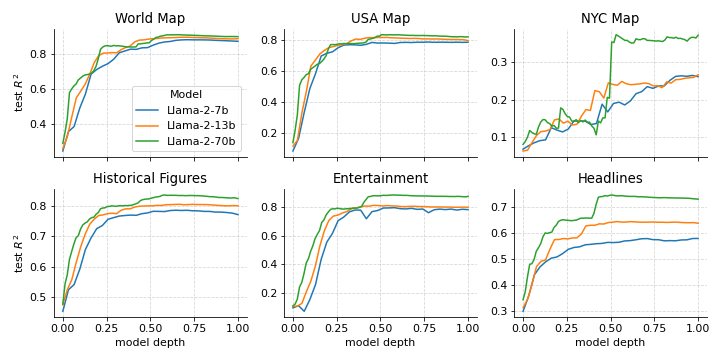

不同模型深度/层数的空间编码可视化效果:

1.2 综合评价

- 本文针对 LLMs 内部的时空信息进行了深入的分析和探索,加深了本人对 LLMs 的理解

- 由于 LLMs 的训练集来自不可控的网络文本,本文对于 LLMs 对世界建模的观点存疑

- 可以考虑通过构建更间接的数据、提示或实体,来探索 LLMs 对时空信息建模的能力边界

1.3 主观评分:⭐⭐⭐⭐

2 精读笔记

数据集:

- 世界空间数据集:报考了维基百科 3 年内页面浏览量低于 5k 的实体

- 美国空间数据集:包括城市、县、邮政编码、大学、自然地点和机构名称

- 纽约空间数据集:包含城市内的学校、教堂、交通设施和公共住房等位置

- 历史人物时间数据集:公元前 1000 年至公元 2000 年之间死亡的历史人物

- 艺术品时间数据集:1950 年至 2020 年歌曲、电影和书籍的标题和创作者

- 新闻时间数据集:2010 年至 2020 年《纽约时报》新闻头条

实验方法:

- 以 Llama2 系列模型为基准,配合一定的提示,在不同层添加线性探针

- 使用岭回归模型作为线性探针,预测每个输入实体的空间坐标或时间信息

- 针对不同层的预测结果进行评估;针对不同层的特征表示进行 PCA 可视化

评价指标:拟合优度R^2,斯皮尔曼相关系数,邻近误差(proximity error)

分析结果 1:不同深度/层数下的线性探针预测性能表现

实验分析结果表明,探针记住了这些群体的绝对定位,但模型确实具有反映相对定位的表示。换句话说,探针学习从模型坐标到人类可解释坐标的映射

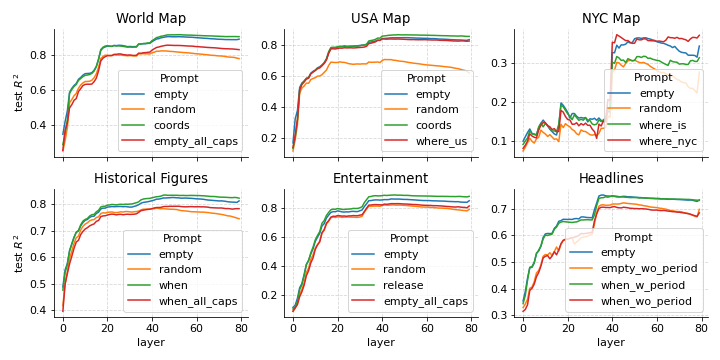

分析结果 2:不同提示词对线性探针预测性能的影响不明显

其他结论:

- 对比线性探针,非线性探针(MLP)不存在显著预测优势(时间空间是线性表示的)

- 通过限制线性探针的可训练参数,验证了空间或时间信息不是存储于线性探针中

- 搜索与探针参数高相似度的神经元,发现 LLMs 内部存在特定神经元来处理时空信息

- 模型在不依赖多步骤推理的情况下难以回答基本的时空关系问题,因果干预分析困难