本文对谷歌年度盘点系列博客进行总结(在原文的基础上进行了一定拓展)

本次盘点由于内容较多,因此拆分为了三部分: Google Research 2022年度盘点 PART Ⅰ Google Research 2022年度盘点 PART Ⅱ Google Research 2022年度盘点 PART Ⅲ

博客主题与原地址:语言模型、计算机视觉、多模式模型、生成模型、负责任的人工智能、机器学习与计算机系统、高效深度学习、算法进步、机器人学、自然科学、健康、社区参与

1 算法进步

1.1 算法拓展:图、聚类和优化

相似性图的构建是大型数据集处理系统的重要组成部分,其中相似图是用于表示不同对象/节点之间相似性的最近邻图;相似性图一般是稀疏的、需要良好的查询性能和可拓展性

- STAR是一种高度可拓展的稀疏图高效构建方法,该方法通过两跳扳手(2-hop spanner)阈值方法来实现相似性图的近似,同时使用局部hash函数来减少邻域搜索负载;该方法在不牺牲图质量的情况下允许构建万亿级的图,并且性能还有显著改善

- 近线性 DBSCAN是一种改进的DBSCAN算法,能在$O(n)$时间内评估密度水平集。该算法一方面基于新颖的网格密度估计方法的近线性时间核心点集构造,避免了k最近邻搜索,另一方面应用局部敏感哈希(LSH)来构造集群。算法在保持和DBSCAN++相似性能的基础上,实现了最优的算法运行速度,尤其是在处理大规模数据的时候

- ParHAC是面向图的并行分层聚集聚类(HAC)算法。该算法将相似度图作为输入,其中包含 n 个顶点(表示输入点)和 m 个加权边(表示点之间的非零相似度)。算法通过重复合并两个最相似的簇来进行聚类,最终输出一棵二叉树,每个顶点对应叶子节点,内部节点对应聚类合并获得的簇。最终实验表明,该算法在经验上实现了聚类质量和运行时间之间的良好平衡,并且可以扩展到数千亿条边的图数据中

两跳扳手(2-hop spanner)阈值方法:

- 要求相似度大于阈值的所有点都通过长度最多为 2 的路径连接

- 不要求相似点必须通过边连接,但存在边连接的点肯定相似度是大于阈值的

- 这可以显着改善图的稀疏性,尤其是在处理万亿级别的大规模相似图的时候

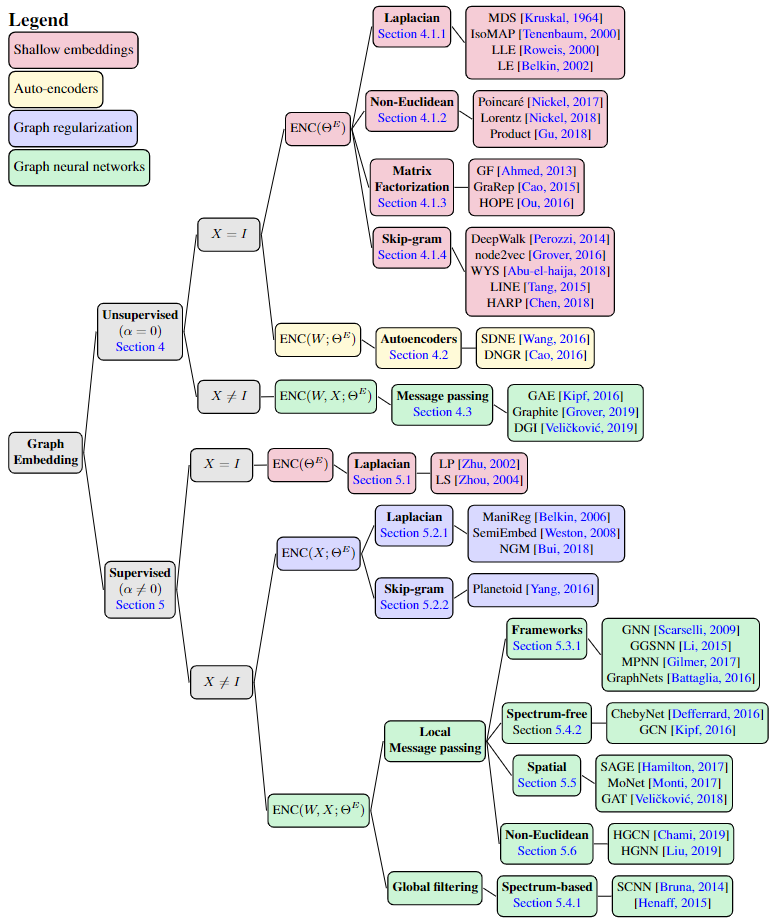

斯坦福、南加州大学和 Google 联合提出了一种图结构数据表征学习方法的综合分类法:

- 提出了图编码器-解码器模型(Graph Encoder Decoder Model, GraphEDM)框架

- 将常用的图半监督学习(如 GraphSage、GCN 和图注意力网络)和图表征无监督学习(如 DeepWalk 和 node2vec)算法泛化统一,并分为四类:浅嵌入、自编码器、图正则化和图神经网络

- 为了阐明这种方法的通用性,研究者将 30 多种现有方法拟合添加进GraphEDM框架中

其他优化或成果简述:

- GNNplus 网络:克服现有 GNN 的深度要求以解决基本的图问题(如最短路径和最小生成树)

- GraphWorld:一种在数百万个综合基准数据集上分析 GNN 架构性能的方法

- TensorFlow (TF-GNN):图神经网络建模库,亮点包括模型库和模型编排 API(轻松构建 GNN)

- 在 ICML’22 举办了基于图形学习的研讨会,在 NeurIPS’22 举办了基于 TensorFlow 的 GNN 教程

- 开源 Vizier:对整个 Google 目标函数和超参数进行黑盒优化的系统

- 原始对偶混合梯度 (PDHG) 解决方案:用于大规模线性规划(LP)问题的新一阶求解器

1.2 隐私和联邦学习

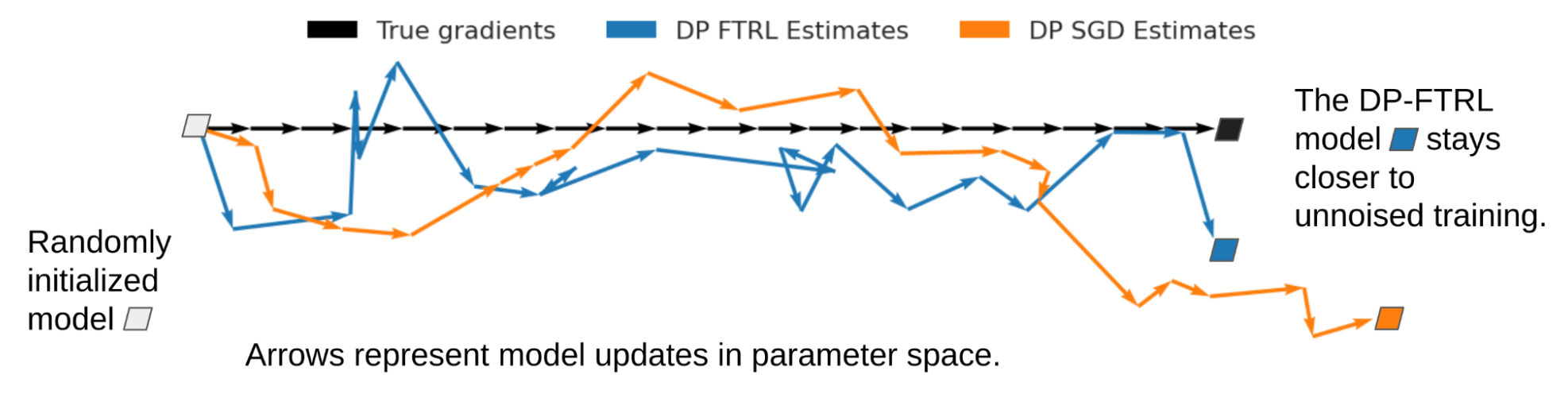

差分隐私(Differential Privacy,DP)是一种隐私保护技术,旨在在发布或共享数据时保护个体的隐私。差分隐私的核心思想是通过模糊化个体贡献,使得攻击者无法从发布的数据中推断出个体的敏感信息

- 基于矩阵分解的 DP-FTRL 方法,使用树聚合技巧在 mini-batch 梯度的总和中添加噪声,以确保算法在不依赖放大隐私的情况下获得最佳的隐私/准确性/计算权衡(更适用于联邦学习的场景)

- 论文提出了一种新的高效 DP 学习算法,为具有基于核假设的平移不变核(例如高斯核)提供边际保证;针对前馈神经网络提供了一个纯 DP 学习算法,并证明了与输入维度无关的边际保证

- 论文填补了理解为什么在大模型微调中不会发生维数灾难的空白。通过使用受限 Lipschitz 连续性的新概念,作者通过微分私有随机梯度下降证明了超额经验误差和超额总体误差的精确的与维度无关的界限

- 在算法方面,提出局部 DP 机制(即使每个样本只有 1 位可用)和高效的 shuffle DP 机制来估计高维分布的熵;提出一种更准确的差分私有方法同时估计数据库中具有最高计数的top-k序列;在大规模并行计算(MPC)模型中展示了一种近乎最优的 DP 聚类近似算法

隐私与其他领域的交叉

- 隐私和流计算:获得了私有频率矩的近乎最优的近似空间权衡,以及用于私有计算滑动窗口流模型中不同元素的新算法,提出了一个用于研究对抗性流算法的通用混合框架

- 隐私和安全:开发了安全、私密且通信高效的新算法,用于测量跨发布商的覆盖范围和频率;开发了安全且私密的新协议,用于在 DP 的双服务器模型中计算稀疏直方图

- 隐私和大模型:调查了LLMs在训练期间忘记(可能记住)训练示例的时间和原因:较早看到的示例可能会以牺牲后来看到的示例为代价而获得隐私优势。针对LLMs泄露记忆(训练数据)的可能性进行了量化

1.3 市场算法和因果推理

谷歌在 2022 年继续研究改善在线市场:

- 继早期分析和改进自动竞价拍卖机制之后,谷歌继续研究在自动化背景下从不同不同方面来改进在线市场,例如用户体验和广告商预算。最终的研究结果表明,即使在不真实的拍卖中,正确结合机器学习建议和随机化技术也可以显着提高自动出价算法之间均衡的整体福利

- 谷歌还研究了复杂环境中的拍卖改进,例如买家设置为由中介代表,以及丰富广告的设置(每个广告可能存在多种不同的显示变体)。谷歌在最近的一项调查中对该领域的工作进行了总结。除了拍卖之外,谷歌还研究了合约在多代理和对抗场景中的使用

在线随机优化仍然是在线广告系统的重要组成部分:

- 双镜像下降(dual mirror descent)是一种简单、稳健且灵活的在线分配问题的新算法;该算法对于各种对抗性和随机输入分布具有鲁棒性,并且可以优化经济效率之外的重要目标,例如公平性;通过根据日益流行的支出回报约束的特殊结构定制双镜像下降,还可以优化广告商价值

- CITransNet:借助Transformer机制将投标人和物品的公共背景信息纳入拍卖学习框架来找到不对称的解决方案,实现为无悔学习的买家设计了效用最大化策略

- 开发了新的学习算法来在拍卖中出价或定价(当买家在预算和投资回报率约束下对价格做出最佳反应时,卖家的收入函数承认钟形结构,从而使我们的卖家算法能够有效地识别收入最优的销售价格)

在线服务的一个关键部分是通过实验测量用户和其他参与者对新措施的反应:

- 结合了图聚类和因果推断的专业知识,通过灵活的响应模型和新的实验设计改进了结果,并更有效地减少了当措施分配和评估测量发生在双边平台的同一侧时的相互作用

- 在数据较少的情况下,将合成控制和优化技术结合起来设计更强大的实验

1.4 算法基础和理论

- 论文使用了一种简单的机制肯定地回答了一个持续四十年的开放问题,即是否存在一种机制,可以保证在买方的价值略高于卖方成本时能够获得一定比例的贸易收益

- 另一篇论文提出了一种新的原对偶算法,流行的高维欧几里得 k 中值和 k 均值问题中获得了最先进的近似比(描述了近似解与最优解之间的差距,值越小越好)

- 改进了相关聚类的最佳近似解,突破了2的近似比的界限

- 在动态数据结构方面解决了最小成本和其他网络流问题,为解决经典离散优化问题做出贡献

2 机器人学

2.1 机器人融合LLMs能力

苏格拉底模型(Socratic Models,SM):一个由多个预训练模型零样本组成的模块化框架,框架通过多模态的通知提示,与每个模型交换信息并捕获新的多模式功能,而无需进行微调。通过最少的工程设计,SM 不仅可以实现最先进的性能,还可以实现新的应用程序:(i)自由形式回答视频中的问题(ii)通过外部 API实现多模式辅助对话(如烹饪食谱) (iii) 机器人感知和规划

PaLM-SayCan:与 Everyday Robots 合作,为机器人提供PaLM 语言模型作为功能模块,以规划长期任务;机器人充当语言模型的“手和眼睛”,而语言模型则提供有关任务的高级语义知识

强化学习需要推理和链接较低级别的技能来应对长期任务,谷歌通过使用与每个较低级别技能相对应的价值函数来产生价值函数空间的表示,该方法可以提高强化学习的长期性能,并实现更好的零样本泛化

内心独白(Inner Monologue):通过不断地将来自各种反馈源的信息(成功检测、对象识别、场景描述和人类交互)添加到LLMs提示中来制定内心独白。该方式显著提高了复杂高级指令的完成度

在“实时与机器人对话”中,谷歌展示了一个大规模模仿学习框架,用于生产实时、开放词汇、语言条件可调的机器人。通过一项策略,该框架能够处理超过 87,000 个独特指令,预计平均成功率为 93.5%。同时作为该项目的一部分,谷歌团队还发布了当前最大的可用语言注释机器人数据集Language-Table,以推动针对实时语言可控机器人的进一步研究

代码即策略(CaP):一种以机器人为中心的语言模型生成程序的表述,在物理系统上执行。 CaP 扩展了之前的工作 PaLM-SayCan,使语言模型能够通过少量提示之间编写具备完整表达的 Python 代码,并完成机器人任务。最终实验表明,该方式不仅可以提高泛化能力和任务性能,也允许系统在没有特定任务培训的情况下执行各种复杂多样的机器人任务

2.2 将机器人学习转化为数据问题

莫拉维克悖论(Moravec's paradox):推理需要很少的计算,但感觉运动和感知技能需要大量的计算资源。比如拾取物体:机器人需要感知和理解环境,推理其抓手与物体之间的空间关系和接触动力学,精确地驱动高自由度手臂,并施加适当的力度稳定地抓住物体而不破坏它的力量

基于 Transformer 的大型模型的泛化和性能随着数据量的增加而扩展,受其启发,机器人学习可以采用数据驱动的方法,将学习低级物理技能的问题转化为可扩展的问题数据问题

Robotics Transformer-1 (RT-1)是一种多任务模型,可标记机器人输入和输出动作(例如相机图像、任务指令和电机命令),以在运行时实现高效推理,这使实时控制变得可行:

- 该模型在包含 13 万个场景的大型现实世界机器人数据集上进行训练,涵盖 700 多个任务

- 数据是使用 Everyday Robots (EDR) 的 13 台机器人在 17 个月内收集的

- 与现有技术相比,RT-1 可以对新任务、环境和对象表现出显着改进的零样本泛化能力

- 说明增加数据的规模和多样性可以提高机器人模型泛化到新任务、环境和对象的能力

Performer-MPC使用由 Performers(一个低阶隐式注意力 Transformer,计算效率优化) 提供的视觉上下文嵌入参数化的学习成本函数,该方法引入了一类新的隐式控制策略,将模仿学习的优点与模型预测控制 (Model Predictive Control,MPC)系统约束的稳健处理相结合

- 与标准 MPC 策略相比,Performer-MPC 在杂乱环境中实现的目标提高了 40% 以上,在人类周围导航时的社交指标提高了 65% 以上;Performer-MPC 为 8.3M 参数模型提供 8 ms 的延迟,使 Transformer 的机器人部署变得切实可行

仿真是一种快速、安全且易于并行化的机器人数据搜索方案,但很难在仿真中复制完整的环境,尤其是物理和人机交互。i-Sim2Real提出了一种解决模拟与真实差距的方法,通过从人类行为的简单模型引导并交替进行模拟训练和现实世界中的部署来学习与人类对手打乒乓球。在每次迭代中,人类行为模型和策略都会得到完善

在学习的早期阶段,机器人很容易出现故障,这可能会对自身和周围环境造成损害。谷歌提出了一种双策略安全的强化学习框架,该框架可以在优化执行所需任务的“学习者策略”和防止机器人进入不安全状态的“安全恢复策略”之间切换,使机器人能够安全地获得新颖而敏捷的运动技能。在“不断学习的腿式机器人”中还训练了一种重置策略,以便机器人能够从故障中恢复,例如在跌倒后学会自己站起来

跨实体逆强化学习 XIRL可以通过观察人类来自学新任务:从视频中学习高级任务目标,并以奖励函数的形式总结知识,该奖励函数对于具体差异(例如形状、动作和结束)是不变的

提高学习算法的数据效率:

- InFuser将策略学习视为连续时间中的潜在状态动态建模,是一种用神经控制微分方程(CDE)训练连续时间策略的统一结构化动力系统架构。此类先验信息有助于缓解探索挑战,并显着减少所需的数据量

- BC-Z是一种简单的模仿学习方法,可以实现对训练期间未见过的新任务的零样本泛化。其关键组成:(i)涵盖 100 种任务的大规模演示数据集(ii)以任务指令(语言或视频)为条件的神经网络策略

- GoalsEye是一种迭代模仿学习算法,能将“从比赛中学习”和“目标条件行为克隆”相结合,用于高速、高精度的乒乓球比赛(不需要奖励设计或模拟到真实的迁移等复杂性)

- 研究了动态系统稳定性,以表征模仿学习的样本复杂性,以及在演示数据中捕获故障和恢复的作用,以更好地条件从小数据集进行离线学习

3 自然科学

3.1 使用ML解开生物学之谜

神经生物学领域

- 探索信息如何通过斑马鱼大脑中的神经元通路传播,深入了解鱼群的社会行为。与马克斯·普朗克生物智能研究所合作,通过计算实现了斑马鱼幼虫大脑神经回路的重建(3D 电子显微镜成像)

- 通过比较人类语言处理和自回归深度语言模型 (DLM) 来揭示人类大脑如何执行语言等非凡功能。最终发现人脑和 DLM 共享了处理语言的三个基本计算原理:下一个单词预测、上下文嵌入依赖、惊喜/惊讶值计算

开发并发布了专为存储和操作 n 维数据设计的 TensorStore,以处理连接组学数据集

生物化学领域

- 利用深度学习的最新成果,根据原始氨基酸序列准确预测蛋白质功能。与欧洲生物信息学研究所 (EMBL-EBI) 合作,仔细评估模型性能,并向公共蛋白质数据库 UniProt、Pfam/InterPro 和 MGnify 添加数亿个功能注释

- Telomere-2-Telomere (T2T)在基因测序方面再次攻克了五个完整染色体臂和近 2 亿个碱基对的新型 DNA 序列。T2T联盟用到了谷歌开源的DeepVariant工具(用来调用对齐的下一代测序读取数据中的遗传变异)和DeepConsensus工具(为测序仪器提供设备上纠错/序列校正)

3.2 量子计算与新的物理发现

在最近谷歌与多所大学的研究人员合作撰写的《科学》论文中表明,只要量子计算机直接耦合到量子传感器并运行学习算法,量子计算就可以从比经典计算少得多的实验中提取信息。即使使用当今嘈杂的中型量子计算机,这种“量子机器学习(Quantum machine learning)”也可以在数据集大小方面产生指数级优势

Quantum AI 团队使用量子计算机进行实验探索,首次观察到使用超导量子位处于束缚态的多个微波光子的实验证据;这种束缚态对扰动具有鲁棒性,该实验为设计利用光子之间相互作用的系统开辟了可能性

4 健康

4.1 技术伙伴关系的重要性

推广使用 ML 来预防服务不足的糖尿病人群失明问题,基于前瞻性介入队列研究证明了解决方案的真实准确性:在2018年12月12日至2020年3月29日期间,对7940名患者进行了筛查。深度学习系统的准确率为94.7%(95%CI 93.0–96.2),灵敏度为91.4%(87.1–95.0),特异性为95.4%(94.1–96.7),优于专家表现

乳腺癌和肺癌是两种最常见的癌症类型。谷歌与业内领先的乳房X线摄影软件提供商iCAD合作,将基于图像识别的乳腺癌筛查技术(与专家相比,准确性更高,假阳性/假阴性更少)集成到产品中。

谷歌与RadNet的Aidence合作,将谷歌健康 AI 研究模型用于 CT 成像上的肺结节恶性肿瘤预测,以支持肺癌的早期和准确诊断。试验已被证明可显着降低男性肺癌死亡率 24%,降低女性肺癌死亡率 33%

与斯坦福大学合作,通过结合新的测序技术和ML来快速诊断遗传疾病,在创纪录的时间内对患者的整个基因组进行测序,从而实现挽救生命的干预措施

与Pacific Biosciences建立合作伙伴关系,将ML技术分层的测序方法推进到研究和临床中的基因组技术中;同年晚些时候,PacBio宣布推出Revio,这是一种由我们的技术提供支持的新基因组测序工具

谷歌在自己的医学成像产品组合中,引入了一种胸部 X 射线模型开发的迁移学习的简化新方法,通过强大高效的自我监督提高医学成像AI的鲁棒性和数据效率,同时提出新技术使得医学成像系统能更好地应对异常值

4.2 转向移动医疗

新研究:

- 通过自拍照片评估心血管健康和视力代谢风险的潜力:糖尿病视网膜疾病AUC为71-82%,HbA1c(糖尿病血糖控制和结果的生物标志物)升高的AUC为67-70%,脂质升高(心血管风险的生物标志物)的AUC为57-68%

- 基于智能手机的心率和呼吸频率测量算法:通过将手指放在后置摄像头上来测量心率(HR),而通过参与者坐在前置摄像头前的视频来测量呼吸频率(RR)。最终平均绝对百分比误差(MAPE)1.6%±4.3%

- 利用新的传感器(低成本手持超声设备)轻松连接到现代智能手机,在资源贫乏的社区实现移动孕产妇超声检查;AI算法能给出胎儿年龄和位置等因素的读数。最终模型准确性与专业超声医师相当

4.3 健康中的生成式ML

生成式模型能提高ML训练数据的多样性,增加医疗应用可用训练数据的有效量

- DermGAN:预先指定的皮肤状况,位置和潜在肤色的特征,生成皮肤图像

- 论文 先各种扫描仪收集图像并标记聚焦区域,之后模拟真实图像失焦前的事件(光学模糊、增加传感器噪声、模拟软件压缩噪声),从而生成具有逼真失焦特征的合成图像

- EHR-Safe提出了一种新的生成建模框架,由顺序编码器-解码器架构和生成对抗网络 (GAN) 组成;最终合成数据需要满足两个关键属性:(i)高保真度(对下游任务有用),(ii)隐私性(不会透露真实患者身份)

论文提出了一个深度潜在状态空间生成模型,通过明确建模患者潜在状态的时间动态来捕获不同类型的相关临床事件(例如,肾衰竭,死亡率)之间的相互作用。这种相互依赖关系的捕捉,有助于未来事件的准确预测和制定更好的治疗计划,也能揭示了有关死亡率和不同类型器官衰竭之间潜在相关性

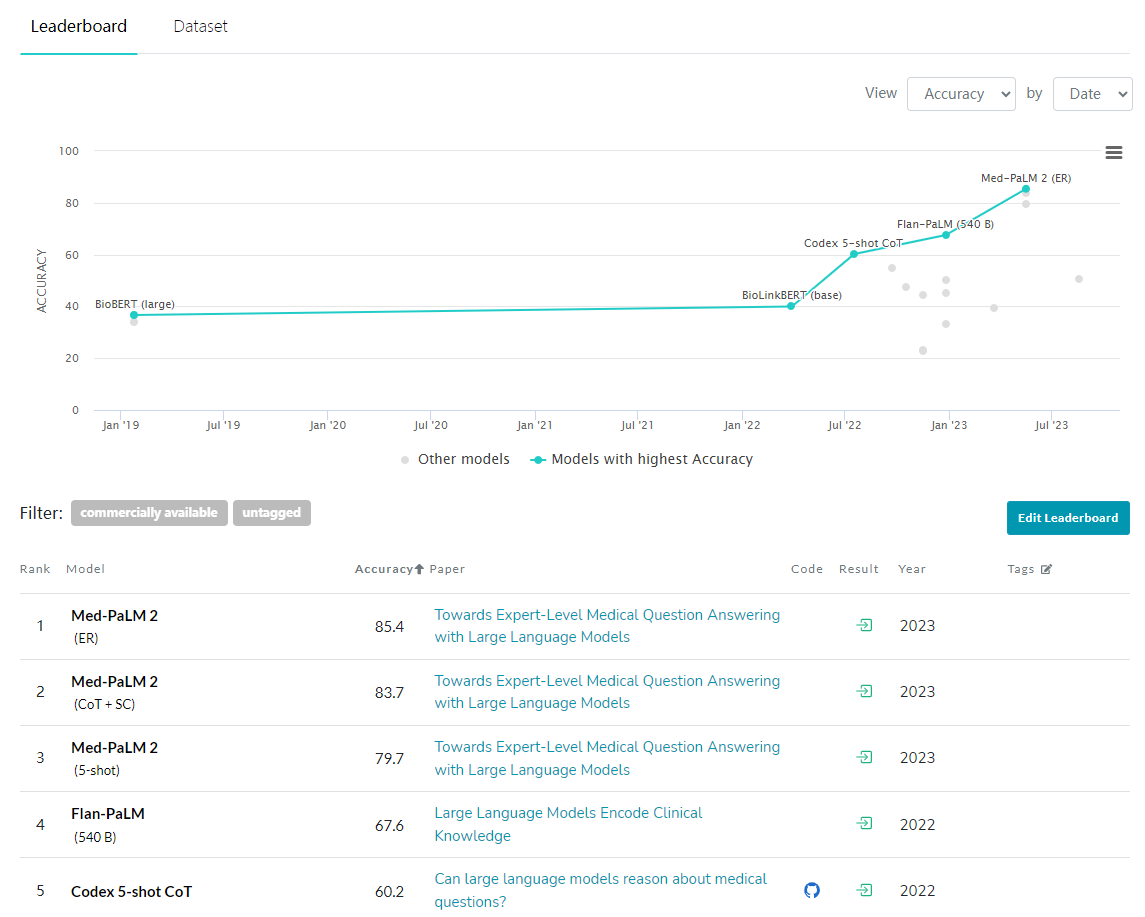

- MultiMedQA 基准测试,结合了六个现有的开放问答数据集,涵盖专业医学检查,研究和消费者查询

- HealthSearchQA,一个新的在线搜索医学问题的免费回答数据集

- 指令调优模型 Flan-PaLM、指令提示调优模型 Med-PaLM 的评估

最近MultiMed评测的模型排名如下(20231019):

5 社区参与

5.1 共同应对社会挑战

获得及时、准确的健康信息是印度农村和人口稠密城市地区妇女面临的一项重大挑战

- ARMMAN 开发了 mMitra:一种免费的移动服务,可向孕妇和新妈妈发送预防性护理信息

- 谷歌也协助设计了ML系统,用于提醒医疗保健提供者有关参与者有退出健康信息计划的风险

- 这种早期识别有助于ARMMAN提供更有针对性的支持,改善孕产妇健康结果

承诺提供300万美元来资助位于保加利亚的新INSAIT研究中心,支持负责任的人工智能项目;向马德拉斯的印度理工学院拨款100万美元,支持建立一个首创的多学科负责任人工智能中心

5.2 培养下一代研究人员

计算机科学研究导师计划通过职业指导、点对点网络和建立对该领域内途径的认识,支持被历史边缘化群体的学生进行计算研究;自 2018 年以来,Google 员工已经指导了 1000 多名学生(86%的边缘人群)

- 将研究互动和计划扩展到拉丁美洲的教师和学生,其中包括资助支持厄瓜多尔计算机科学领域的女性

- 与法国的一所大学ENS合作,帮助资助奖学金,让学生通过研究进行培训

- 与西班牙裔服务机构计算联盟 (CAHSI) 合作,提供 480 万美元,以支持30 多个合作研究项目和 3,000 多名西班牙裔学生和教师,跨越西班牙裔服务机构网络

- 与莱斯大学举办数据科学应用和研究区域研讨会(ReWARDS),为学生提供研究方面的入门经验

- 投入资金,帮助肯恩大学创建了研究新兵计划,为本科生提供与教师导师一起参与研究的入门机会

- 与非营利组织Black in Robotics(BiR)合作,旨在解决机器人社区的系统性不平等问题

- 设立了博士生奖,以帮助在经济上支持研究生并支持BiR新成立的湾区机器人实验室

- 帮助世界各地的更多研究人员参加全球会议,资助学生参加深度学习Indaba(非洲ML会议)

5.3 合作推进科学创新

2022 年,谷歌赞助了 150 多个研究会议,以及更多的研讨会,例如 2022 年量子研讨会

撰写了 2400 篇论文,其中许多论文在领先的研究会议上发表,例如 NeurIPS、EMNLP、ECCV、Interspeech、ICML、CVPR、ICLR 等。论文中超过50%是与谷歌以外的研究人员合作撰写的

向研究人员提供了超过 224 笔赠款,并获得了超过 1000 万美元的 Google Cloud Platform 积分

向 9 个国家的 65 个机构做出了 22 项新的多年承诺,总额超过 ~8000 万美元;每年我们将举办研讨会,以选择共同感兴趣的 100 多个研究项目;与台湾四所大学(NTU,NCKU,NYCU,NTHU)密切合作(增强芯片设计与半导体竞争力);被评为澳大利亚顶级合作公司之一

5.4 推动产品和工程创新

利用的海底互联网电缆来检测地震

合作开发 Minerva:

- 一种能够使用逐步推理解决数学和科学问题的语言模型

- 通过在包含符号表达式的定量推理的数据集上训练深度学习模型来实现

- 结合了多种技术,包括少镜头提示、思维链或暂存提示以及多数投票

- 在各种困难的定量推理任务上取得了显着的性能提升

5.5 开源数据集和工具

感谢观看~ 明年见