本文对谷歌年度盘点博客进行总结(在原文的基础上进行了一定拓展)

相比于 2022 年,2023 年的总结明显精简了许多(从 10 篇 blog 浓缩为 1 篇)

1 产品和技术

该小节将按照时间线的顺序,依次介绍 Google 在 2023 年发布的重要产品

1.1 Bard 大语言模型

Bard:实验性对话式人工智能服务(2023 年 2 月)

Bard 的最初版本是 LaMDA 模型(2021 年)的轻量化版本,性能表现一般;Bard 从 2023 年 7 月份才支持中文;而在 2023 年 12 月 6 日,Bard 被性能更强劲的 Gemini Pro 替代(从此推出了历史舞台~)

1.2 Google I/O 大会

2023 年 5 月 Google I/O 大会 推出了很多基础与应用成果

- PaLM2:在 PaLM 模型的基础上增强了多语言翻译与逻辑推理能力,兼备计算优化缩放、缩放指令微调和改进的数据集混合等特点,还可以针对不同目的对模型进行微调和指令调整

- 搜索增强 SGE(实验性产品,需申请):使用 LLMs (依赖 PaLM2)重新组织信息并帮助人们浏览信息;给出后续步骤的建议、辅助复杂的购物决策(依赖于谷歌的购物图谱,约包含 350 亿产品)、推送有价值的流量

- MusicLM(需注册申请试用),根据文本描述或指定旋律生成高保真音乐(依赖 AudioLM 模型实现从文本到音频的生成,同时也依赖 MuLan 模型对音频和文本的联合嵌入表示)

- Duet AI 人工智能协作工具,帮助用户编写、创建图像、分析电子表格、起草和总结电子邮件和聊天消息,以及总结会议(Google Workspace 场景);或者帮助用户编码、部署、扩展和监控应用程序,以及识别和加速解决网络安全威胁(Google Cloud 场景)

Google Workspace 是谷歌在订阅基础上提供的一套云计算生产力和协作软件工具和软件。它涵盖了谷歌广受欢迎的网上应用,包括 Gmail、谷歌云端硬盘、谷歌 Chat、谷歌日历和 Google 文档

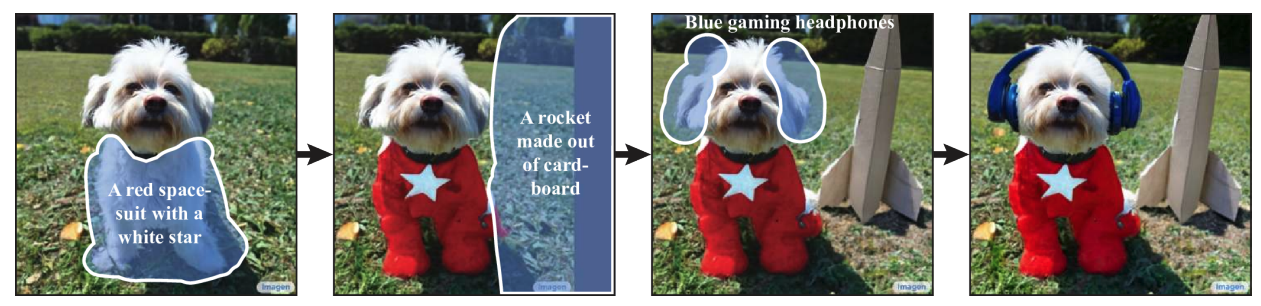

1.3 Imagen Editor 图像编辑

Imagen Editor :借助区域蒙版和文本提示以交互方式编辑生成图像(2023 年 6 月)

- Imagen Editor 是在 Imagen 模型 (谷歌在 2022 年推出的文本生成图像的扩散模型,在语言理解和照片保真度方面表现出色)基础上的微调,其目标是改进语言输入的表示、细粒度控制和高保真输出

- Imagen Editor 的输入:(1)需要编辑的图像(2)用于指定编辑区域的蒙版(3)文本提示

- Imagen Editor 的核心技术(1)使用对象检测器模块在训练期间生成对象蒙版,促进文本提示与蒙版区域的对齐;(2)将输入图像和蒙版的通道级串联来增强高分辨率图像的编辑,在基础扩散模型(64x64)和超分辨率模型(256x256,1024x1024)间应用下采样卷积来实现生成图像的高保真(3)应用无分类器指导(CFG)在文本条件和无条件模型输出间进行插值,确保生成图像和文本提示之间的紧密对齐

- 对于单图像人类评估,Imagen Editor 获得了最高评分(比第二高表现模型高 10-13%);得益于性能更高的 T5 XXL 文本编码器,Imagen Editor 对文本语义有较好的理解;Imagen Editor 在文本对齐方面也表现出色

该论文 在 CVPR 2023 发表,项目地址能看到更多演示;

目前 Imagen Editor 的功能已经集成到 Imagen 这一产品中(付费)

1.4 Deep Aligner 口语练习

Deep Aligner:帮助人们练习口语并提高语言技能(2023 年 10 月)

- 场景:当进行单词检索或学习时,谷歌搜索会根据提供的词汇形成一套个性化的练习题(耗时约 3~5 分钟),并给出标准答案和解题思路(个性化反馈是有效练习的关键);选择注册后还可以进行每日训练

- Deep Aligner 是该功能的核心技术,其显着提高了所有测试语言对的对齐质量,平均对齐错误率(AER,衡量单词对齐质量的指标,越低越好)从 25% (1_study/algorithm/概率图类模型/隐马尔可夫模型 HMM )降低到 5%;因此在练习过程中,学习者可以点击任何他们不理解的单词,根据上下文查看该单词的翻译

- 此外,还会有语法校正模型 实现自动语音识别 (ASR) 转录(语法反馈);基于 LaMDA 或 PaLM 模型判断给定的响应在上下文中是否合理(语义分析);模型还会评估问题的难度,并根据学习者的能力水平提高适当而有挑战的练习

刚推出时,只支持印度、印度尼西亚、阿根廷、哥伦比亚、墨西哥或委内瑞拉等地的用户。目前(20240703)好像还不支持中文,实测使用手机端的谷歌搜索单词时确实会触发并生成一些自动练习题,只不过没有口语练习?

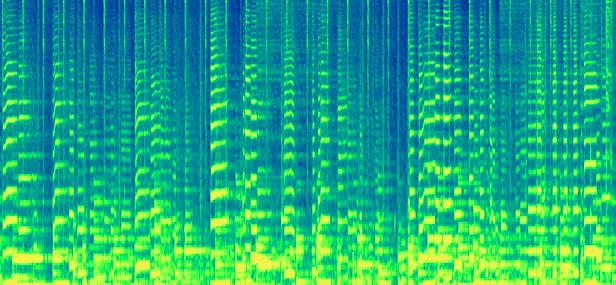

1.5 Lyria 音乐生成

Lyria:Deepmind 与 Youtube 合作推出的 AI 音乐生成模型(2023 年 11 月)

- Dream Track 实验:与艺术家一起合作生成不同风格配乐,共同设计了一套音乐 AI 工具;能做不同音乐风格和乐器之间切换;自动创建乐器和声乐伴奏

- SynthID:将音频转换为视觉频谱图以添加数字水印,以确定歌曲中的某些部分是否由 Lyria 生成;而音频内容经过常见的修改(加噪/压缩/调速)后其水印仍能保持可检测性

- AI 原则:实现创造性表达,同时保护音乐艺术家及其作品的完整性

对于文本生成,SynthID 会在不影响生成文本质量的情况下调整输出 token 的概率分布;对于图像生成,则是通过神经网络模型生成肉眼不可见的像素修改,但可以由另一个神经网络识别(即使图片经过了剪切、编辑、旋转或有损压缩)

1.6 Gemini 多模态大模型

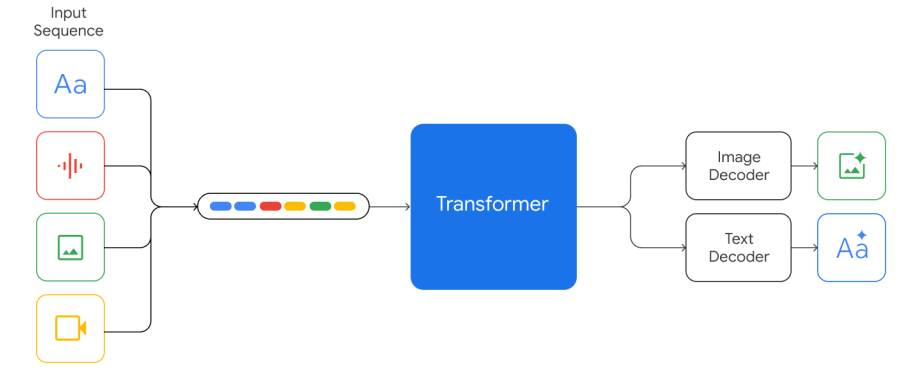

Gemini:跨文本、音频、图像和视频的多模式 AI 模型(2023 年 12 月)

- Gemini 1.0 提供三种不同尺寸:Nano(适合手机等设备端部署,分为 1.8B 的 Nano1 和 3.25B 的 Nano2)、Pro(适合跨任务的扩展)和 Ultra(适合高度复杂的任务)

- Gemini Ultra 在 MMLU:多语言知识理解上的得分高达 90.04%,超越人类专家;在八项基准测试中的六项中,Gemini Pro 的表现优于 GPT-3.5;更多细节可参与 Gemini 技术报告

- AlphaCode 2 是 Gemini 的编程增强版本,在编程比赛中表现优于 85% 的参赛者

除了 Gemini API,Gemini 目前可在 Google AI Studio(谷歌提供的 AI 开发者工具,Gemini Pro 有60 次/每分钟的免费额度)和 Vertex AI (谷歌云提供的全托管 AI 开发平台)上使用

后来的 Gemini1.5 又出了一个 FLASH 版本,介于 Nano 和 Pro 之间~

2 ML/AI 研究

2.1 算法提示-改善 LLMs 推理能力

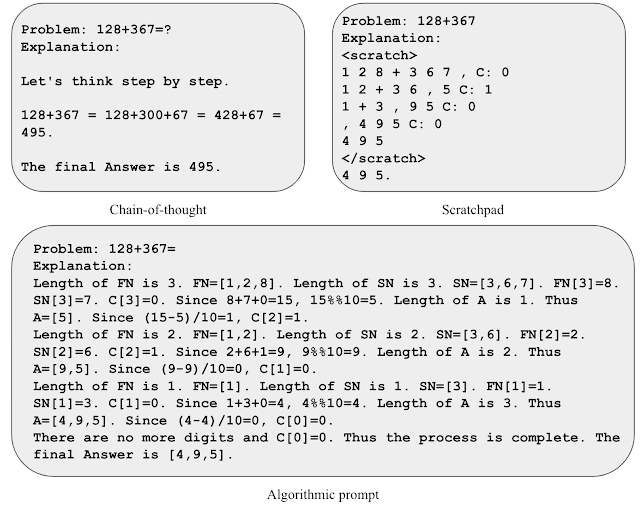

算法提示 algorithmic prompting:增强 LLMs 的算术推理能力

- 思维链(Chain-of-thought)通过简单的任务拆分来改善模型的运算逻辑

- Scratchpad 提示通过跟踪程序状态的中间步骤来模拟运行已经写入的编码

- 算法提示则包含显式方程来描述进位规则,实现更精准细致的解释和提示(为每个计算步骤提供了明确的方程,并以明确的格式描述了各种索引操作)

- 算法提示与其他提示方法的区别:(1)针对问题直接输出算法解决方案所需的步骤(2)每个算法步骤都会进行解释,充分的细节确保 LLMs 不会产生误解

- 算法提示的实验效果:将一项中学数学基准的准确率从 25.9% 提高到 61.1%

2.2 CodeVQA 通过编程进行视觉问答

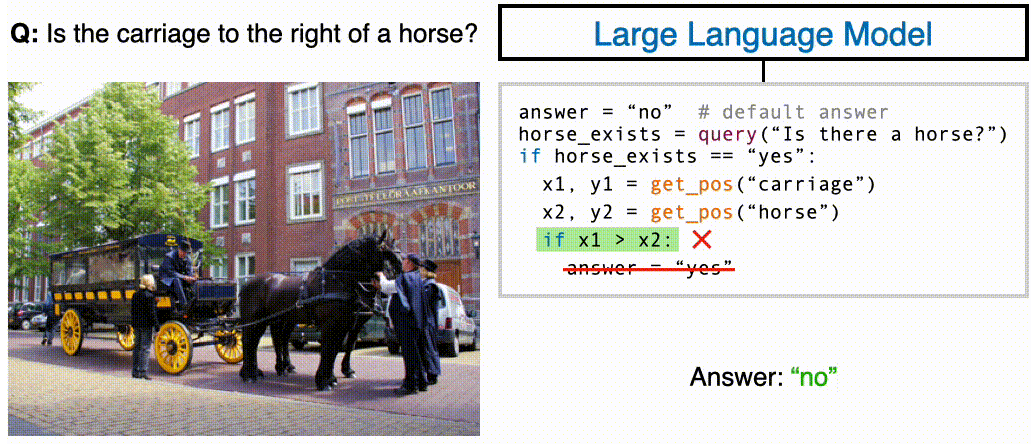

CodeVQA 基于 LLMs 生成代码来实现视觉问答(VQA)

- 当给出有关图像或图像集的问题时,CodeVQA 会生成一个具有简单视觉功能的 Python 程序(代码),使其能够处理图像,并执行该程序以确定答案。

- CodeVQA 框架包含 3 个视觉函数实例(1)

query,根据图片生成视觉问答的标题和答案,用于后续的训练(2)get_pos,对象定位器,根据对象的文本描述返回其在图像中的坐标(3)find_mathcing_image,图像匹配器,在多图像问题中根据文本描述返回最匹配的图像 - 实验证明,在少样本学习场景下,CodeVQA 在 COVR 数据集上的性能比之前的工作高出大约 3%,在 GQA 数据集上的性能比之前的工作高出 2%;空间推理能力比基线高约 30%

- 此外,CodeVQA 提供了额外的可解释性(通过 Python 程序)和可控性(通过提示或视觉函数)

2.3 DIDACT 软件开发通用模型

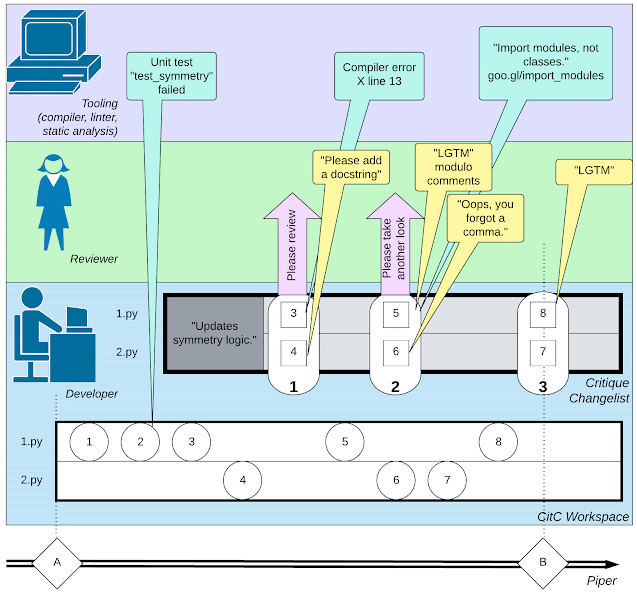

DIDACT 面向软件开发的多任务模型:

- DIDACT 根据 Google 的软件开发流程构建 ML 开发人员助理的培训演示(逐步构建代码,并与工具和代码审查人员交互),并使用这些演示来训练模型(而不只是最终的代码)

- 因此 DIDACT 能更好地了解软件开发的动态过程,并根据开发者操作实现更合理的响应

- DIDACT 定义了很多种任务(预测/修复编译错误、预测/修复审核问题修复、变量重命名、文件编辑等 )用于训练;每个任务的输入为状态(代码文件)和意图(特定任务的标识),输出是一个操作(为解决任务而采取的行为操作)

- 状态-意图-行动(State-Intent-Action)的定义形式能够以通用的方式捕捉不同的任务,使得最终的 DIDACT 支持代码编辑、注释、调试、修复和审查等功能,甚至预测开发人员的行为

2.4 谷歌地图的逆强化学习

逆强化学习(inverse reinforcement learning,IRL):给定马尔可夫决策过程(MDP)——道路网络的结构化数据和一组演示轨迹(行驶路线),IRL 的目标是恢复用户的潜在奖励函数

奖励函数的应用:先在服务器离线评估整个图的奖励并存储到内存数据库中(降低在线推理的成本),然后使用快速在线图搜索算法来找到在任何起止位置间的最高奖励路径(改善服务的成本和延迟)

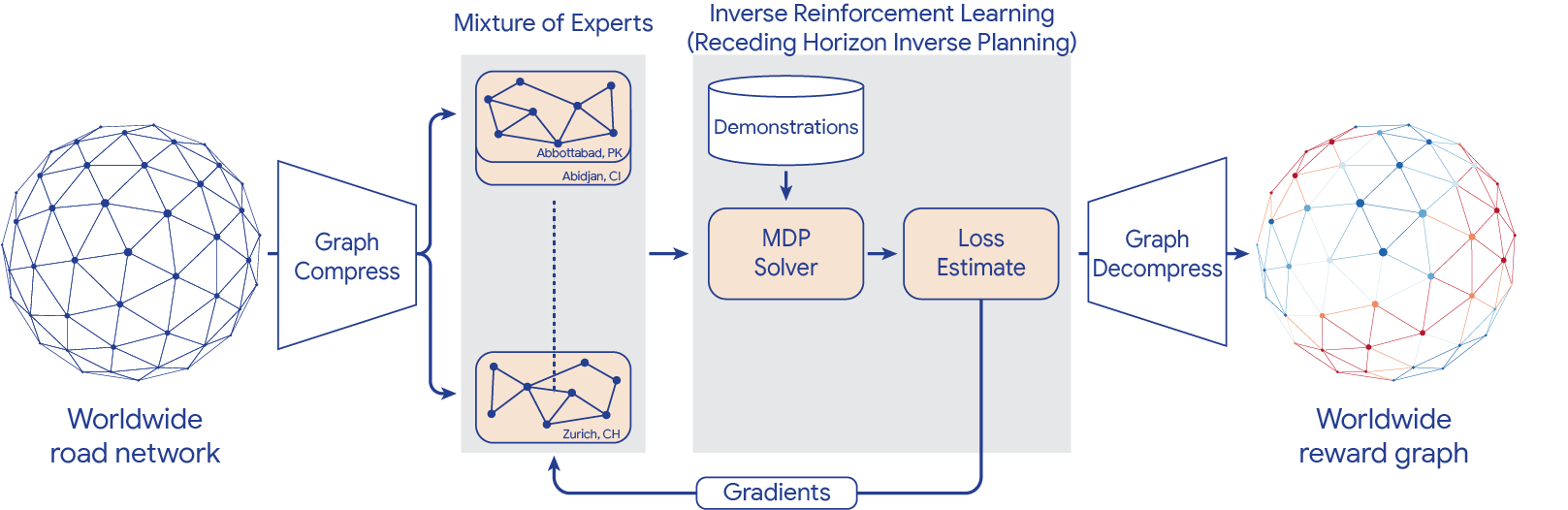

Receding Horizon Inverse Planning (RHIP) :世界规模的 IRL 算法

- RHIP 使用基于区域的稀疏专家混合 (MoE)模型对全局 MDP 进行压缩和分区,然后应用 RHIP 算法来求解本地 MDP,估计损失,并将梯度发送回 MoE;全球奖励图则是通过解压最终的 MoE 奖励模型来计算的。

- RHIP 在演示路径周围的局部区域使用稳健但昂贵的随机策略,并在超出某个范围时改用更便宜的确定性规划器,从而避免了"维度的诅咒"并提供了对性能权衡的细粒度控制

- 最终的 RHIP 策略在全局路线匹配率(即实际行驶路线中与 Google 地图中建议路线完全匹配的占比)方面实现了 16-24% 的相对改进;是迄今为止现实世界中最大的 IRL 实例

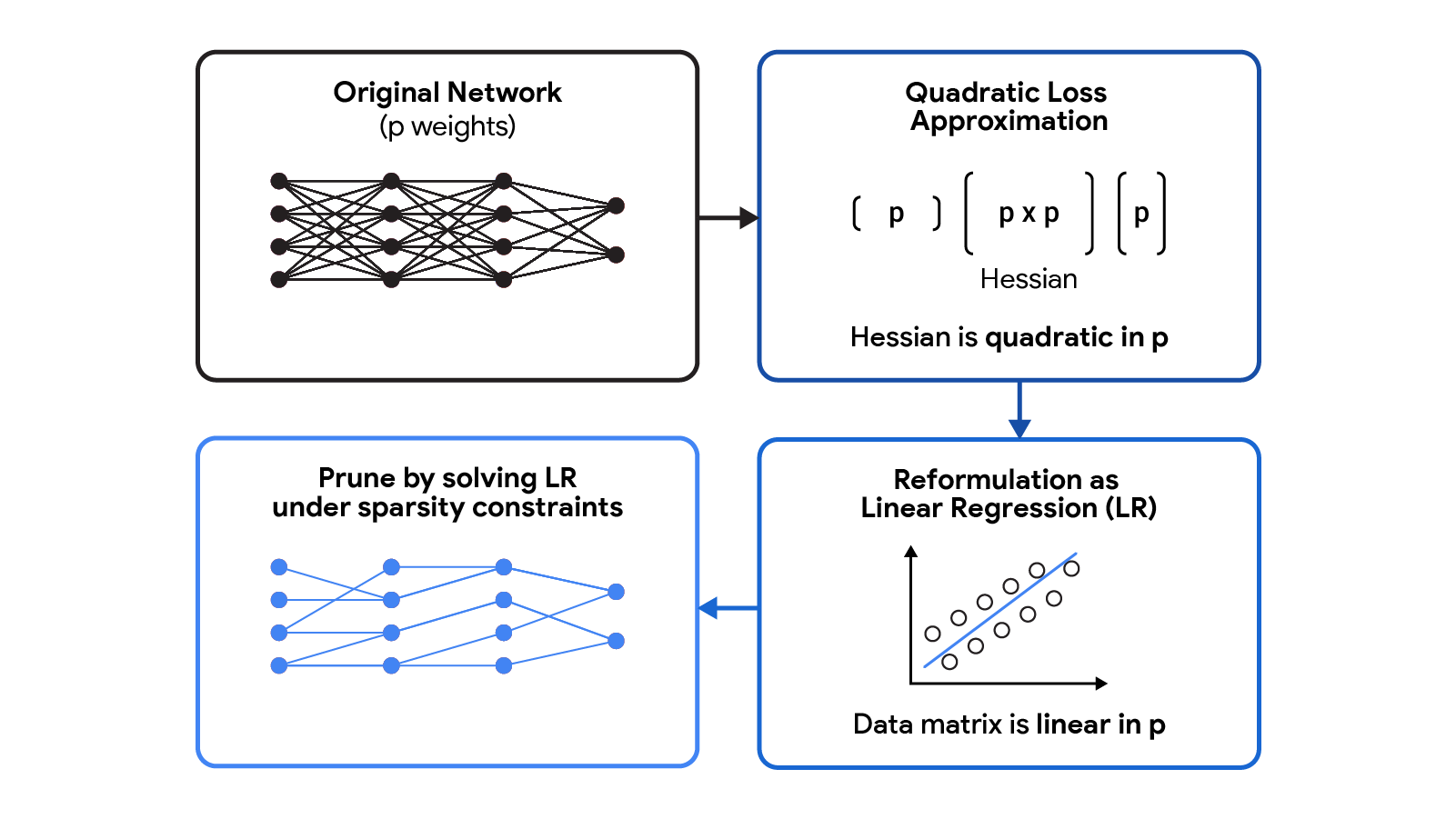

2.5 CHITA 神经网络快速剪枝

基于优化的剪枝,根据权重的删除对损失函数的影响程度来决定剪枝

- CHITA 将需要昂贵的 Hessian 矩阵(目标函数的二阶偏导数矩阵)的二次损失近似重新表述为线性回归 (LR) 问题,每个回归系数对应于神经网络中的特定权重(系数为 0 的边意味着可以被剪枝)

- 其他优化:利用 Hessian 矩阵的低秩性质,避免了存储和计算大型 Hessian 矩阵;迭代硬阈值(IHT)算法后处理,只保留幅度最大的 k 个系数(其他系数置为 0)

- CHITA 算法能够从图像分类模型中修剪 70% 的边,并且保持准确性几乎不变;CHITA 的速度比最先进的 ResNet 修剪方法快 20 倍到 1000 倍,同时准确性提高了 10% 以上

个人理解:Hessian 矩阵包含了基于目标函数的梯度导数信息,因此转化为线性回归问题的本质是通过对模型权重的随机扰动,来评估(拟合)其对损失函数的影响;所以回归系数描述了模型权重的随机扰动对损失项的影响程度,回归系数值为 0 即表示该权重可被舍弃

2.6 扩散模型的设备加速

Speed Is All You Need(CVPR 2023):在移动 GPU 上优化大型扩散模型

- 优化 1:局部融合 softmax,消除了在注意模块中的 softmax 和矩阵乘法间的大量内存读写

- 优化 2:FlashAttention,基于硬件 I/O 感知注意算法,减少了 GPU 高带宽内存访问量

- 优化 3:Winograd 快速卷积,以增加内存消耗为代价实现卷积加速(权衡内存消耗和计算效率)

- 优化 4:融合定制专门的 GELU(高斯误差线性单元) 和组归一化运算符,提高内存效率

最终效果:只需 12 秒即可在智能手机上生成的逼真高分辨率图像

提示词:“a photo realistic and high resolution image of a cute puppy with surrounding flowers”

提示词:“a photo realistic and high resolution image of a cute puppy with surrounding flowers”

2.7 机器人相关工作

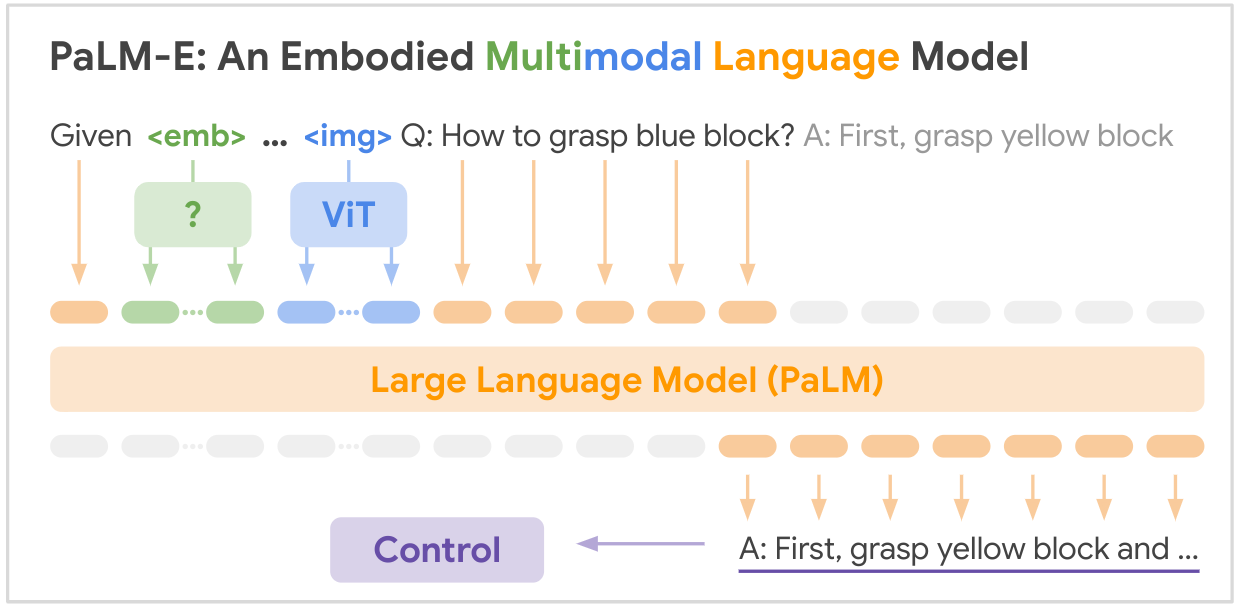

PaLM-E:机器人多模态模型,依赖 PaLM 大语言模型和机器人传感器数据(E)

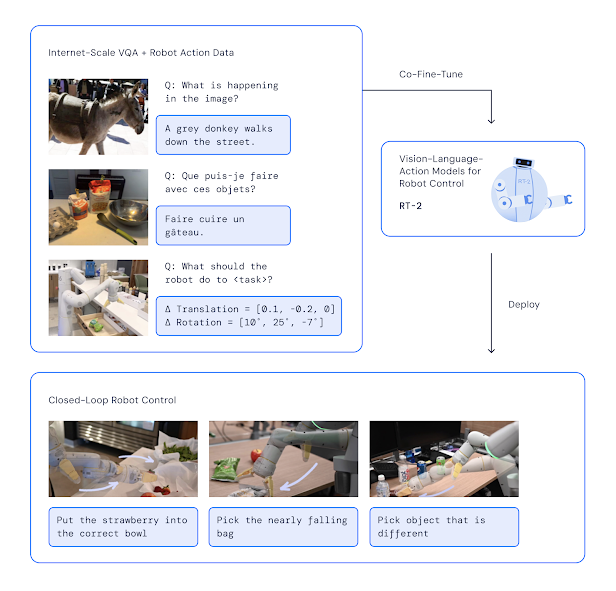

Robotic Transformer 2(RT2) 视觉-语言-动作 (VLA) 模型

- 在机器人和网络数据上共同微调预先训练的视觉语言模型

- 生成的模型接收机器人摄像头图像并直接预测机器人要执行的动作

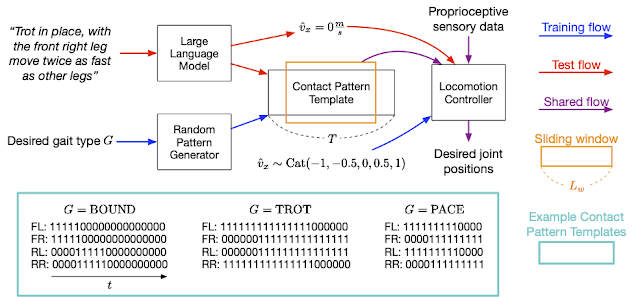

SayTap:四足机器人的语言

- SayTap 使用脚接触模式(contact pattern template),如上图所示;四只脚对应四行 0/1 序列(0 表示脚在空中,1 表示脚在地面上)作为接口桥接用户文本命令和低级控制指令

- SayTap 通过基于强化学习的运动控制器,经过训练以实现所需的接触模式,SayTap 允许四足机器人接受简单和直接的指令(例如,“缓慢地向前小跑”)以及模糊的用户命令(例如,“好消息,我们这个周末要去野餐!”),并做出相应的反应

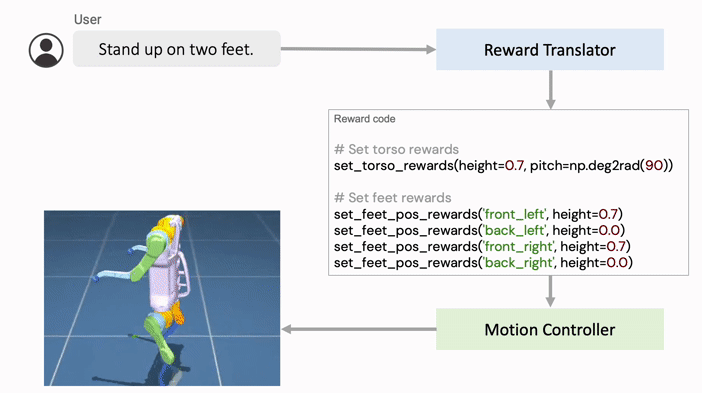

四足机器人的综合奖励

- 用户能够通过利用 LLMs 将自然语言用户指令转换奖励代码 (Python 形式)

- 运动控制器使用后退地平线优化(receding horizon optimization)来优化给定的奖励函数,以找到最佳的低级机器人动作(每个电机的扭矩量)

奖励函数作为接口,弥合语言和低级机器人动作之间的差距,从而教机器人学会新的动作

3 算法与优化

3.1 AlphaDev 发现快排算法

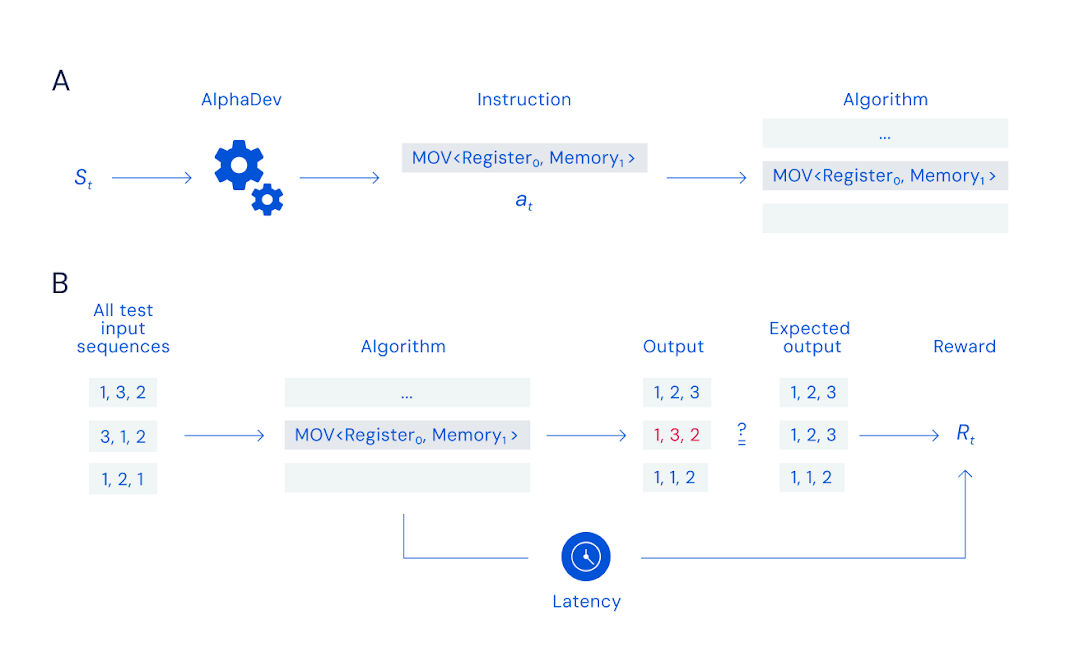

AlphaDev 基于强化学习发现/增强计算机算法(2023.03 发表于 Nature)

- AlphaDev 以 AlphaGo Zero 为基础,从汇编指令作为切入口(相对于高级编程语言,可能存在更多的改进空间,对算法性能和能源消耗影响更大)发现更快的排序方法

- 具体来说,AlphaDev 将排序算法转化为单人"组装游戏":在每一次迭代中,AlphaDev 会观察上一轮生成的算法和对应的 CPU 信息,之后对算法添加新的指令(instruction)

- 对于 AlphaDev 调整后的算法,输入测试用例(test input)得到实际输出,并与期望的理想输出进行对比,根据准确率和允许效率得到当前算法的奖励信息(进而指导下一轮的迭代)

- AlphaDev 需要搜索大量的潜在指令组合,以找到一种可以排序的高效算法;指令组合的数量级,接近宇宙的粒子数,也接近 10120 局国际象棋或 10700 局围棋的可能走法组合

- 最终 AlphaDev 发现了一种新的快排算法,对于短序列的排序速度提高了 70%(AlphaDev 更专注于短序列的优化),对于超长序列(>25w)的排序速度提高了约 1.7%

后续:

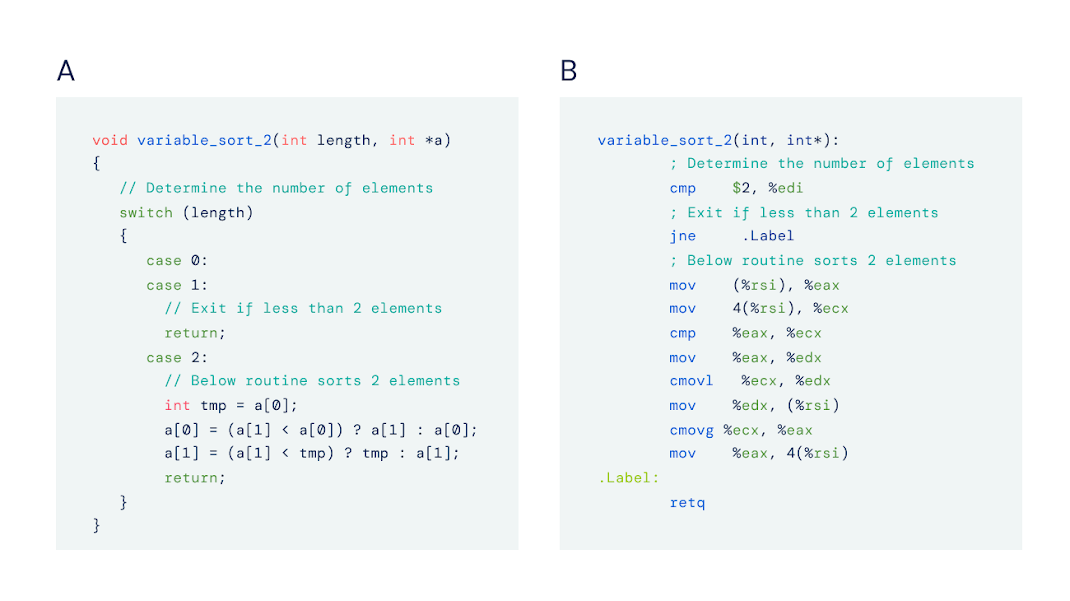

- 通过逆向工程将该快排算法翻译为 C++语言,并添加到了 LLVM libc++ 标准库中

- 将 AlphaDev 的思路用到了哈希算法中,使得 9~16 位的哈希算法速度提到了 30%

补充:对元素进行排序(左为 C++算法示例,右为对应的汇编表示)

3.2 GST-EFD 预测大型图的属性

GST-EFD:有限内存条件下的大型图属性预测

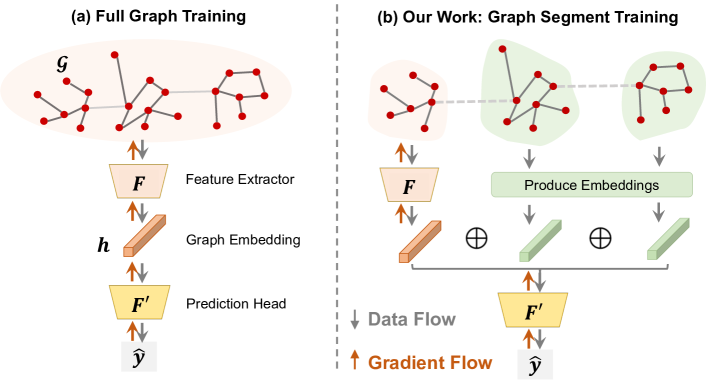

- 图分段训练(Graph Segment Training,GST)框架先将大图进行切割,得到尺寸较小的分段图;然后在训练过程中,GST 仅使用随机采样的部分分段图进行训练迭代(其他分段图只参与正向传播,不需要计算梯度并进行反向传播),从而减少内存的消耗

- GST+E:引入额外的历史嵌入表来存储每个分段图的历史嵌入,方便未被采样到的分段图计算

- GST+EF:增加了预测头微调;在训练结束后,使用最新的特征提取器更新所有分段图的嵌入,然后仅对预测头进行微调;解决训练和预测阶段的分布不一致问题,改善模型的可拓展性

- GST+EFD:应用陈旧嵌入丢弃(Stale Embedding Dropout,SED)技术;在训练阶段,随机丢弃部分历史嵌入,并增加剩余嵌入的权重;减少由于历史嵌入引起的偏差

- 实验表明,GST-EFD 既节省内存又速度快,与典型的全图训练方案相比准确性还略有提高

谷歌还发布了图性能预测数据集 TPUGraphs,以加速该领域的开放研究

3.3 Prequal 负载均衡算法

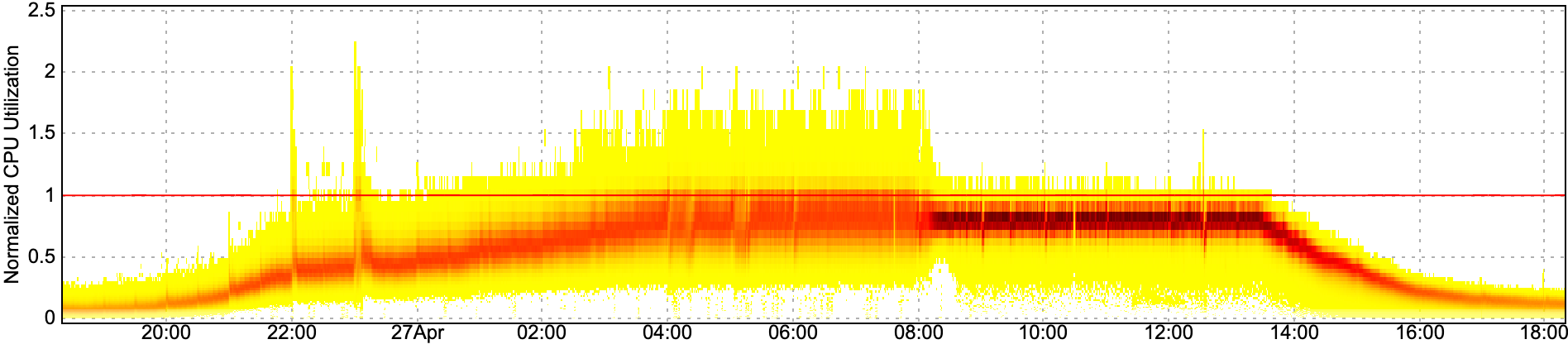

Prequal:分布式多租户系统设计的负载均衡器,追求最小化实时请求延迟

- 上图为 CPU 使用热图,负载均衡器在 8 点左右切换为 Prequal(热图明显收敛)

- Prequal 通过主动向服务器发送探测请求来获取服务器的负载信息,而不是被动接收

- 异步和可重用的探测:Prequal 引入了异步探测机制,减少了探测的开销,同时保持了负载信号的新鲜度。探测可以被重用,以减少 CPU 和关键路径延迟的开销

- Prequal 根据服务器的估计延迟和活跃的请求在途(Requests-in-Flight, RIF)来选择服务器,以减少尾部延迟;避免了将查询分配给 RIF 异常高的服务器副本,限制服务器副本上的 RAM 占用

- Prequal 作为负载均衡策略在 Google 内部的与现有的系统和框架集成;在 Google 的多个大型服务上部署了两年多,包括 YouTube,显著降低了尾部延迟、错误率和资源使用

对该领域不熟悉,因此仅为略讲;细节可能存在不足之处

3.4 图聚类和文本聚类

本小节涉及算法仅作简单描述,不深究细节

相关性聚类(Correlation Clustering)问题的全新解决方案:

- 问题描述:寻找一种最优的顶点划分方式,最小化不一致边的总权重

- 应用场景:如基因聚类、重复检测、社区挖掘、社交网络分析等

- 方案特点:一种新的预聚类方法+基于集的舍入技术,显著提高了算法的近似比

解决大规模并行图聚类(MPC)模型下的最小生成树(MST)问题:

- 最小生成树(MST)是一个包含所有顶点的无环子图,其总边权重最小

- 在高维空间中,已知的算法要获得一个常数近似解需要 O(log n)轮,而谷歌则提出了一种新的算法能够在在 O(log log n)轮内获得高维欧几里得 MST 常数近似解

TeraHAC:解决大规模图数据集上的层次聚类问题

- 与之前已知的 HAC 计算方法相比,TeraHAC 所需的轮数减少了 100 倍以上

- 比最先进的分层聚类分布式算法 SCC 快 8.3 倍,同时质量提高 1.16 倍

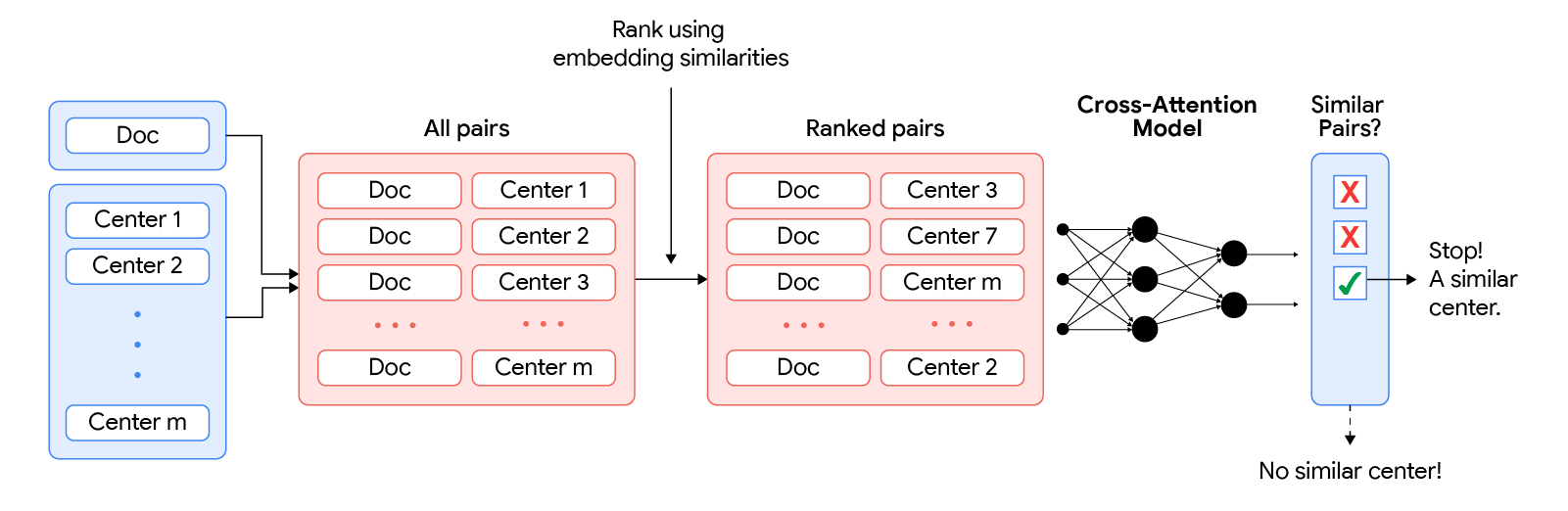

KwikBucks:文本聚类与相似文档查询

- 首先随机选择一组文档进行相关性聚类得到 $m$ 个中心(Center)及其簇(clusters)

- 之后给定查询,通过基于交叉注意力(Cross-Attention,CA)模型进行文本对的相似度评估,推断是否存在于查询相似的聚类中心;存在时则通过簇选择的限制来节省预算

- 当两个簇之间存在强连接(簇间的边连接数>边缺失数)时执行后处理进行簇的合并;同时为了确保可扩展性,使用文本嵌入表示的相似性分数来过滤潜在的合并

3.5 嵌入模型的优化

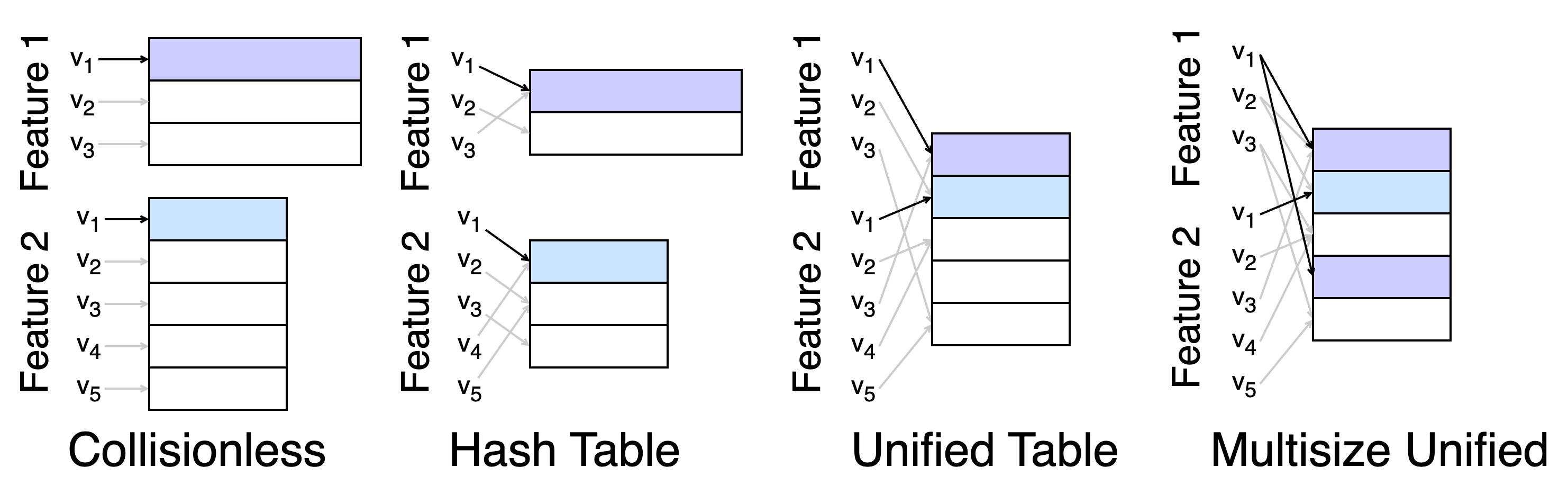

哈希嵌入:每个特征值都被分配给表中的多行,最终的嵌入是行的加权总和

组合嵌入:在多个独立的表中查找特征,并通过串联、加法或逐元素乘积构建最终嵌入

特征复用(Feature Multiplexing) 嵌入学习框架,实现高维特征嵌入的高效学习:

- 允许多个不同的分类特征共享单一的表示空间(即一个嵌入表);原则上,任何特征嵌入方案(例如,哈希嵌入、组合嵌入等)都可以用作特征多路复用的共享表示

- 对于具有不同维度(多尺寸或可变长度)的统一嵌入,执行多次查找并将结果连接起来

- 框架优势:简化的功能配置、对动态数据分布的强适应性以及与 ML 加速器的兼容性。久经考验:在多个大型 SAR(搜索和检索)系统中使用,显著提升了用户参与度指标和关键业务指标

顺序注意力:用于特征选择问题(ICLR 2023)

- 算法引入一组可训练变量来自适应表示特征的重要性或注意力权重

- 基于贪婪的前向选择算法,在多轮中逐步考虑边际贡献最大的特征

4 科学与社会

4.1 可持续性和气候变化

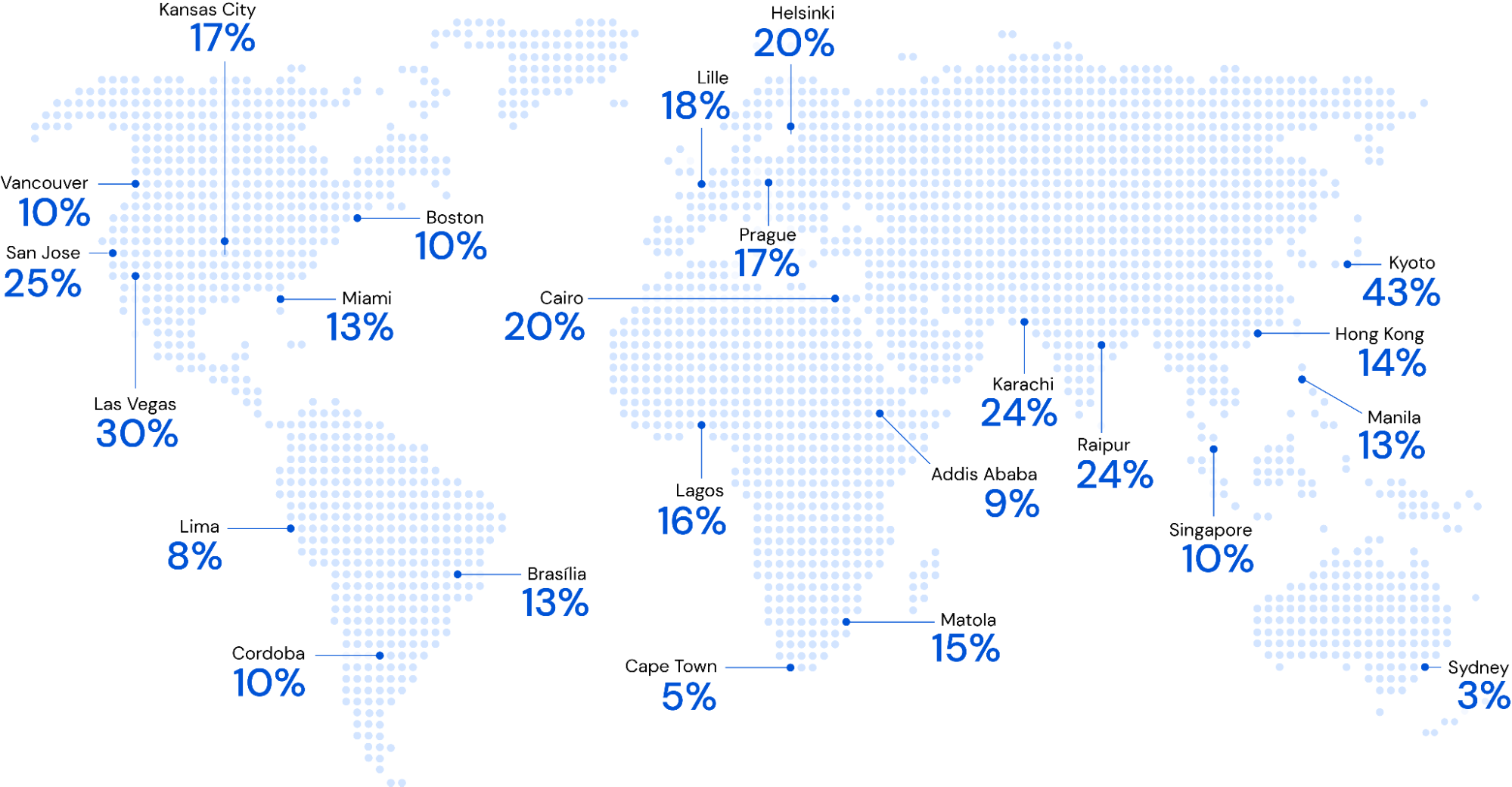

绿灯计划:与全球 13 个城市合作,帮助改善十字路口的交通流量并减少排放

- 凝迹(飞机飞过湿度层时留下的细白线)会额外捕捉热能,导致净变暖效应

- 分析了大规模天气数据、历史卫星图像和过去的航班预测凝结尾迹

- 训练了一个 AI 模型来预测凝结尾迹的形成位置并相应地重新调整飞机航线

- 与美国航空和 Breakthrough Energy 合作,使用该系统证明凝结尾迹减少了 54%

Flood Hub洪水预报和可视化平台覆盖范围扩大到80个国家,直接影响超过4.6亿人;使用卫星图像实时跟踪野火边界,改进野火风险的社区紧急疏散计划;Tree Canopy 平台,帮助城市更好地了解在哪里种植更多树木以减少"热岛效应";Tree Equity Score 评分工具,确保城市的遮荫得到公平分配

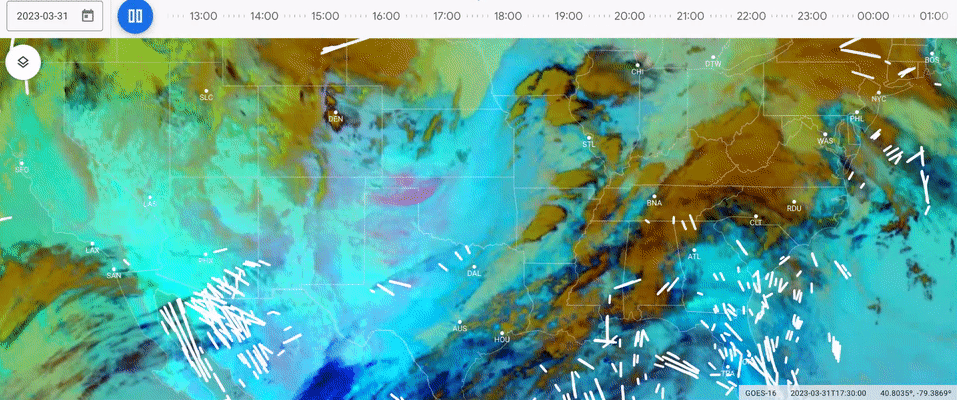

MetNet-3 长期天气预报模型

- 根据降水、地表温度、风速和风向以及露点(空气饱和并水蒸气凝结形成露水的温度)等核心特征提供长达 24 小时的高分辨率(时间分辨率为 2 分钟,空间分辨率为 1~4 公里)天气预测

- MetNet-3 已投入使用,其预报可在多个与天气相关的 Google 产品中提供;对于邻近的美国和欧洲,可生成实时 12 小时降水预报(优于最先进的基于物理的模型)

4.2 健康与生命科学

Med-PaLM2 多模态医疗大模型

- 使用相同的模型权重灵活地编码和解释生物医学数据,包括临床语言、成像和基因组学(多模态)

- Med-PaLM 模型是第一个能够在美国医疗执照考试中取得及格分数的模型,而 Med-PaLM 2 模型则进一步提高了 19%,达到 86.5% 的专家级准确率

- Med-PaLM 模型根据 14 项标准进行了测试——包括科学事实性、精确性、医学共识、推理、偏见和伤害——并由来自不同背景和国家的临床医生和非临床医生进行评估(距离高标准应用还存在较大差距)

CoDoC 综合 AI 意见和临床流程的决策辅助

- CoDoC 系统,学习何时依赖 AI 预测工具或服从临床医生,以最准确地解释医学图像

- 与常用的临床工作流程相比,CoDoC 将大型、去标识化的英国乳腺 X 线摄影数据集的假阳性数量减少了 25%,而不会遗漏任何真阳性(相关代码已开源)

REMEDIS:医学影像的大规模自我监督学习框架

- REMEDIS 先使用 Big Transfer (BiT,谷歌在2019年提出的一种迁移学习方法) 在大规模自然图像预训练初始化的表示,然后无医疗标注数据的情况下用对比自监督学习使模型适应医学领域,最后在特定下游医疗图像任务上进行模型的微调

- REMEDIS 在各种医疗任务中的表现优于在 JFT-300M 上预先训练的监督基线,并展示了改进的数据效率泛化,将数据需求减少了 3-100 倍(大幅减少数据标注和系统开发成本)

FDA MyStudies平台:开源移动端数据收集平台,跟踪多发性硬化症(MS)患者的症状

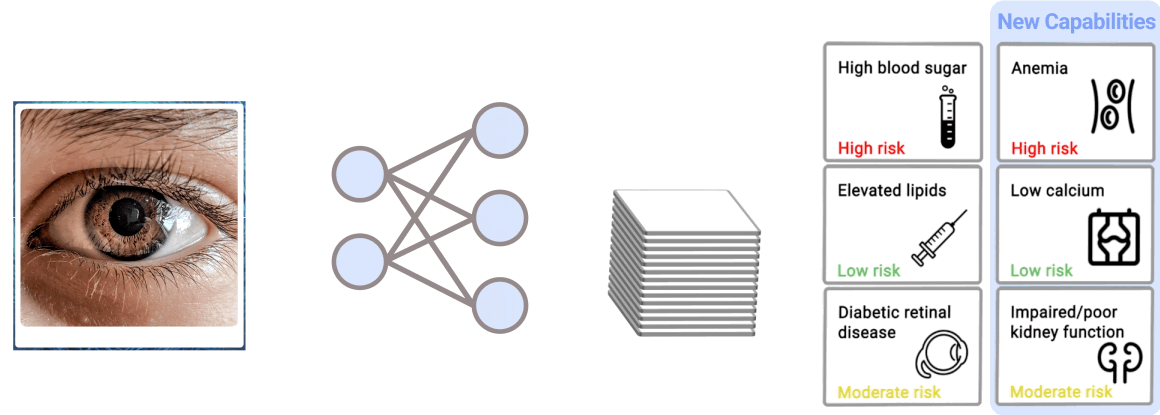

深度学习模型:根据眼部图像预测全身生物标志物

- 该模型的准确性超过了仅使用临床人口学变量的基线逻辑回归模型

- 模型预测的全身生物标志物及其疾病意义:

| 预测任务 | 器官系统 | 疾病的意义 |

|---|---|---|

| Albumin < 3.5 g/dL | 肝脏/肾脏 | 低白蛋白血症的指征,这可能是由于肝病导致的白蛋白生成减少或肾脏疾病导致的白蛋白丢失增加所致。 |

| AST > 36.0 U/L | 肝 | 肝病(即肝脏损伤或胆道梗阻)的指征,通常由病毒感染、饮酒和肥胖引起。 |

| Calcium < 8.6 mg/dL <br> | 骨骼/矿物质 | 低钙血症的指征,最常见的原因是维生素 D 缺乏或甲状旁腺疾病。 |

| eGFR < 60.0 mL/min/1.73 m2 | 肾 | 慢性肾病的指征,最常见的原因是糖尿病和高血压。 |

| Hgb < 11.0 g/dL <br> | 血细胞计数 | 贫血的指征,可能是由于失血、慢性疾病或不良饮食造成的。 |

| Platelet < 150.0 103/µL | 血细胞计数 | 血小板减少症的指征,这可能是由于骨髓疾病(如白血病或淋巴瘤)产生的血小板减少,或自身免疫性疾病或药物副作用导致的血小板破坏增加。 |

| TSH > 4.0 mU/L | 甲状腺 | 甲状腺功能减退症的指征,甲状腺功能减退症会影响新陈代谢,并可能由许多不同的疾病引起。 |

| Urine albumin/creatinine ratio (ACR) ≥ 300.0 mg/g | 肾 | 慢性肾病的指征,最常见的原因是糖尿病和高血压。 |

| WBC < 4.0 103/µL <br> | 血细胞计数 | 白细胞减少症的指征,会影响身体抵抗感染的能力 |

下一代 AlphaFold 的最新进展

- 对7100万个基因“错义”突变的影响进行分类,帮助查明疾病原因

- 蛋白质数据库(PDB 中的几乎所有分子进行预测,通常达到原子精度

- 模型的理解能力增强,显着提高了多个关键生物分子类别的准确性,包括配体(小分子)、蛋白质、核酸(DNA 和 RNA)以及含有翻译后修饰 (PTM) 的配体

5 负责任的 AI 研究

5.1 负责任的设计

生成式人工智能系统的社会技术安全评估

- 提出了一个三层框架来评估人工智能系统的社会和伦理风险。该框架包括对人工智能系统能力、人机交互和系统影响的评估(更多细节可查阅原始论文)

- 基于 LLMs 的规模化对抗性数据合成工具,优先生成反映不同社会背景的数据集,并集成数据质量指标(语言风格、多元文化、预期一致性,对抗性分析)以提高数据质量和多样性

- 自动化测试集评估和社区参与;引入评分指南来提高人类评分的质量和准确性;使用基于 LLMs 的自动测试集评估来提高效率和可拓展性;复杂或模棱两可的案例转交给人类专家

- 评分者多样性,考虑各种交叉因素(人口统计学 vs 内容特征)对安全感知的影响

与 Howard 大学合作,建立高质量的非裔美国英语 (AAE) 数据集改善模型偏见

基于 AI 的印度电视中的人口代表性研究(部分结论)

- 女性角色的屏幕时间比男性角色多,女性角色的屏幕时间接近 55.8%,而男性为 44.2%,孟加拉语和泰卢固语节目为女性角色提供的屏幕时间比例最高,在所有语言中约为 59%。

- 当在屏幕上显示时,女性角色往往比男性角色更年轻,肤色更浅。银幕上70%的女性角色年龄在18至32岁之间,肤色较浅,而男性角色的这一比例为52.9%,他们代表了更广泛的年龄和肤色范围。

- 泰米尔语和泰卢固语电视节目呈现的肤色范围更广,肤色较深的角色占据的屏幕时间比其他语言节目多,约为 23%,后者显示中等或深肤色的角色在 13% 到 18% 的屏幕时间之间。

MakerSuite 工具演示:参数高效调整(Parameter Efficient Tuning,PET)

SynthID:水印添加和识别工具,提高 AI 内容的安全性和透明度

隐私保护学习算法 DP-FTRL,在确保隐私/准确率的情况下允许更灵活的数据访问

首届机器遗忘挑战赛,以解决忘记训练图像以保护个人隐私或权利的情况

Euphonia 项目:非典型语音录音语料库扩展至超过 100 万条,实现 37%的非典型语音识别

STUDY 算法:为有阅读障碍(例如阅读障碍)的学生建立了有声读物推荐系统

5.2 对抗性测试与 AI 民主

与公平人工智能研究圆桌会议 (EARR) 等团体合作,确定生成模型输出中的潜在危害

Google AI Red 团队:专注于测试 AI 模型和产品的安全、隐私和滥用风险

- 诸如“投毒”或对抗性示例之类的攻击可以应用于生产模型,并暴露出其他风险

- 防御此类攻击可能具有挑战性,因为仅仅应用防御可能会导致其他安全和隐私泄露

- 引入了针对极端风险(比如网络攻击、深度欺骗、恐怖主义)的模型评估

通过工具和教育使人工智能民主化

- MakerSuite(Google AI Studio)一款 AI 驱动基于 Web 的轻量级 AI 开发工具

- LIT 1.0 一款用于机器学习模型的最先进的开源调试器

- Colab 为开发人员和学生在 Web 端提供强大的计算资源,用户已超过 1000 万

FunSearch:使用进化方法和 LLMs 生成在数学科学中可验证的真实知识

《人类 + AI 指南》:使用 AI 进行设计的方法、最佳实践和示例