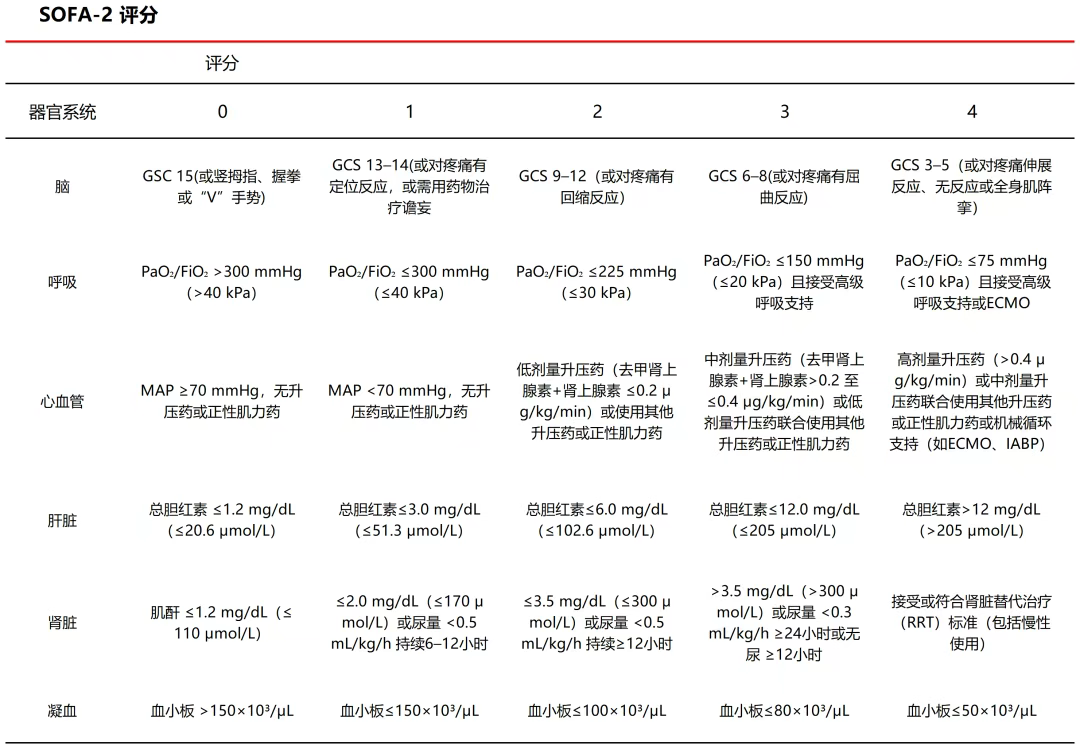

前置知识: SOFA评分

SOFA2 评分总结(图源):

呼吸系统

| 分值 | SOFA 经典版 | SOFA2 |

|---|---|---|

| 0 | PaO2/FiO2 ≥400mmHg | PaO2/FiO2 >300mmHg |

| 1 | PaO2/FiO2 <400 | PaO2/FiO2 ≤300 |

| 2 | PaO2/FiO2 <300 | PaO2/FiO2 ≤225 |

| 3 | PaO2/FiO2 <200 且需机械通气(无创/有创) | PaO2/FiO2 ≤15 |

分类目录归档:学习

增强语言模型(Augmented Language Models,ALM)

按照模型增强的方式可大致分为:检索增强、编程增强、工具增强、综合增强

编程增强:

倒数排名融合(Reciprocal Rank Fusion,RRF)

RRF 的核心公式: $$ RRFscore(d\in D) = \Sigma_{r\in R}\frac{1}{k+r(d)} $$

RRF 的简单示例:

docA 在三次不同的检索策略中出现,检索排名分别 1、2、1docA 的最终 RRF 得前置知识:检索增强 RAG,

相比于朴素 RAG,高级 RAG 在预检索过程(Pre-Retrieval Process) 和 后检索过程(Post-Retrieval Process) 两个阶段引入了一些改进措施,提高检索质量

前置知识:强化学习入门、Q-Learning

Dyna 是一种经典的强化学习算法

前置知识:强化学习入门、Deep Q-Learning、策略梯度算法

Actor-Critic (简称 AC)是一种经典的强化学习框架

AC 算法的 Actor 策略函数近似 $$ \pi_{\theta}(s,a) = P(a|s,\theta)\approx \pi(a|s) $$

前置知识:强化学习入门、Deep Q-Learning

策略梯度(Policy Gradient)

基于价值(Value Based)方法的局限性:

基于策略的

Deep Q-Learning,简称 DQN

DQN 算法步骤